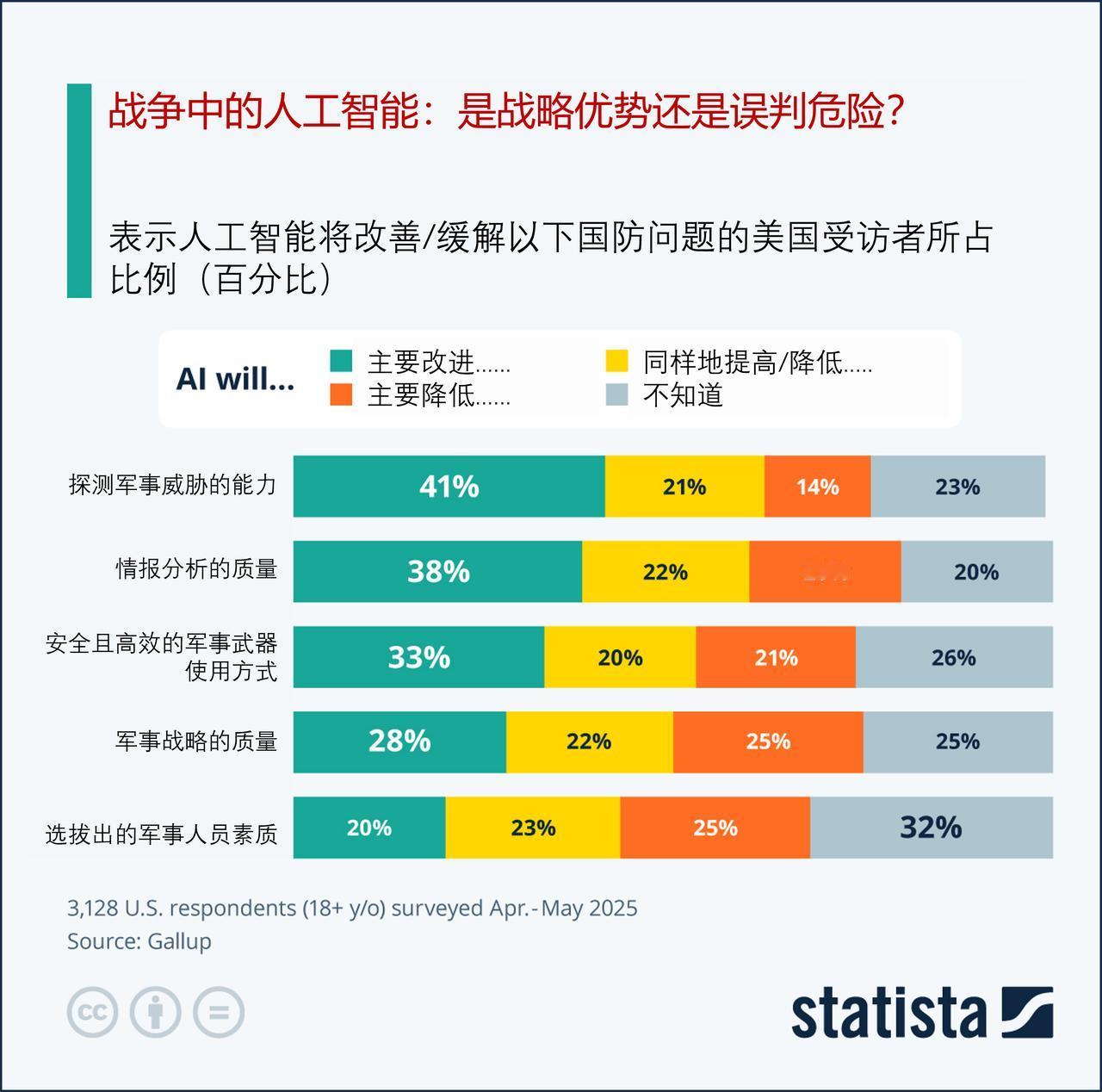

人工智能在战争中的应用:是战略优势还是误判的危险? 美国国防部已启动一项新的人工智能加速战略,旨在确保在军事人工智能领域的主导地位。据该部门称,新战略将“释放试验活力,消除遗留的官僚障碍,并将前沿人工智能技术的最尖端能力整合到每一个任务领域”。 这一策略出台之际,人们对在战争中使用人工智能的风险愈发担忧。《原子科学家公报》的科学家警告称,将人工智能应用于战争武器,包括其未来可能在核武器中的应用,令人高度担忧。美国已要求承包商将人工智能整合到非核指挥和控制系统中,而据报道,俄罗斯也在探索类似应用于核指挥和控制系统的途径。据《原子科学家公报》报道,人工智能还被用于乌克兰的瞄准系统,以色列据称也使用了基于人工智能的系统在加沙地区生成目标清单。 在美国,公众对于这一话题的看法仍存在分歧。最近的一项盖洛普民意调查发现,41%的美国人认为人工智能会增加国家安全风险,而 37%的人则认为它会降低这些风险。对于开发基于人工智能的自主武器,人们的看法也存在类似分歧。有 48%的人反对这种武器的开发,而 39%的人支持。然而,当受访者被问及如果其他国家先开发此类武器他们会作何反应时,支持的比例上升到了 53%。 在谈到人工智能在军事行动中的具体应用案例时,人们的看法也各不相同,所有领域都存在广泛的不确定性。美国成年人对人工智能在提高威胁检测能力(41%)和情报分析能力(38%)方面最为乐观,但认为它能改善武器的安全使用(33%)、军事战略(28%)或人员选拔(20%)的人则相对较少。