在苹果宣布WWDC25将于2025年6月10日召开后,iOS19的诸多变革细节逐渐浮出水面。作为iOS7以来最大规模的系统重构,这次升级不仅带来颠覆性的视觉设计,更在AI能力、跨设备协同和交互逻辑上实现突破,甚至被业界视为苹果布局AR/VR生态的关键落子。

一、设计革命:从二维平面到三维空间

1.visionOS基因的全新界面

iOS19首次将VisionPro头显的visionOS设计语言引入手机端,主屏幕图标采用动态立体悬浮设计,轻触时浮现立体光效,下拉菜单、控制中心等组件则通过半透明毛玻璃效果营造「无边框」沉浸感。系统级应用集体换装,例如相机界面取消传统按钮布局,改用可拖动的透明悬浮气泡控件,取景框面积扩大15%,让拍摄更聚焦主体。

2.生态统一战略

设计语言首次实现iPhone、iPad、Mac三端统一,为折叠屏、AR眼镜等未来设备预留交互接口。开发者需重构应用界面以适配新规范,这也意味着初期部分第三方App可能出现适配问题。

二、AI能力:从工具到「私人智能体」

1.Siri的「ChatGPT时刻」

整合自研大语言模型的Siri实现多轮自然对话,支持跨应用复杂指令执行。例如用户可语音指示「查找北京至上海下周五上午高铁票,对比车次价格并预订高铁站附近评分4.5+酒店」,系统将自动调用地图、购票平台和酒店预订应用完成任务。但受限于芯片性能,该功能仅限iPhone15Pro及以上机型。

2.健康监测体系升级

依托AppleWatch传感器数据,新增「AI健康教练」功能:通过摄像头分析健身姿势并提供矫正建议,根据心率变异性预警潜在健康风险,甚至结合饮食记录生成个性化营养方案。不过该功能可能分阶段上线,基础版随正式版推送,食物追踪等进阶功能延至iOS19.4。

三、影像系统:专业性与易用性平衡

1.相机界面史诗级重构

采用visionOS风格的透明分层菜单,将照片/视频模式切换、分辨率设置等控件整合为底部悬浮栏,顶部新增专业参数调节面板。用户可手动调整快门速度、ISO等参数,并通过拖拽气泡控件实现单手操作。空间视频录制功能下放至iPhone15系列,为VisionPro生态提供内容支持。

2.实时创作工具

深度融合生成式AI的图像编辑器支持「文字描述修图」:输入「增加晚霞饱和度」「模拟胶片颗粒」等指令即可自动调整。该功能依赖A17及以上芯片的神经网络引擎,老机型仅支持基础滤镜。

四、兼容性与隐私保护

1.设备支持策略调整

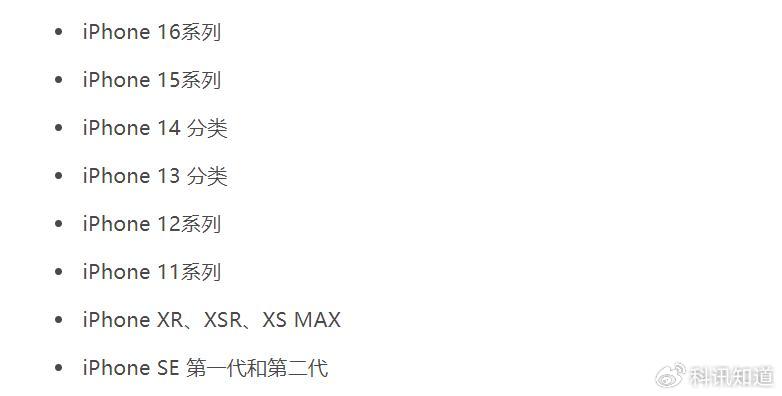

尽管iOS19仍支持iPhoneXR/XS等A12芯片机型,但多项核心功能(如动态界面、AI服务)仅限iPhone11及以上设备。部分爆料指出,A12设备可能被完全排除在升级名单之外,这意味iPhoneX系列或将终结更新周期。

2.隐私计算架构

AppleIntelligence采用「端-云协同」模式:日常任务由设备端模型处理,复杂计算则通过搭载苹果芯片的私有云完成,且所有云端数据均经加密且不留存。用户可通过「隐私仪表盘」查看各功能的数据调用记录。

五、生态互联:空间计算的基石

1.跨设备无缝体验

AirPodsPro新增实时同声传译功能,结合iPhone的翻译引擎实现多语言混合对话字幕投射。Mac与iPad可实时同步iOS19的「空间工作区」,文件拖拽、应用接力等操作延迟降低至30ms以内。

2.开发者新机遇

苹果开放ARKit7.0接口,支持开发者调用系统级3D渲染引擎,这在相机应用的「虚拟取景」功能中已初现端倪——拍摄时可叠加现实场景与数字元素,为AR内容创作开辟新路径。

变革背后的战略深意

iOS19的激进革新绝非简单的功能堆砌。通过统一设计语言、强化AI内核、优化跨端协同,苹果正构建「空间计算」的基础框架。随着iPhone16系列或搭载的UWB芯片升级,未来手机有望成为连接现实与虚拟世界的核心终端。这场始于视觉革命的系统升级,或许正在书写移动交互的下一个十年。