朋友们,你们是否想过,一个由20万张GPU训练出来的人工智能,到底有多强?

当我第一次听到“Grok-3”这个名字时,心里忍不住琢磨——这可是全球首富马斯克的得意之作,能有多牛?

有人觉得这是AI界的又一次噱头,也有人则坚信这是未来智能的开端。

到底是花瓶还是真材实料,我们一探究竟。

Grok 3模型家族亮相Grok-3,这个名字第一次出现在大众视野时,大家可能都和我一样心生疑惑:为什么叫Grok?

据说,这个名字来自一部小说,意思是“完全理解”,看来这可是要走心的。

xAI的工程师透露,Grok 3其实并不是单一的模型,而是一个模型家族。

这个家族里有一个小家伙叫Grok 3 mini,虽然为了提升响应速度牺牲了一些准确度,但依然表现不俗。

发布当天,虽然所有大模型暂时没完全上线,但是据说很快就要全军出击。

马斯克还在推特(现称X平台)上爆料,原本想要发布的语音模式还有点小问题,不过也就在一周左右会推出。

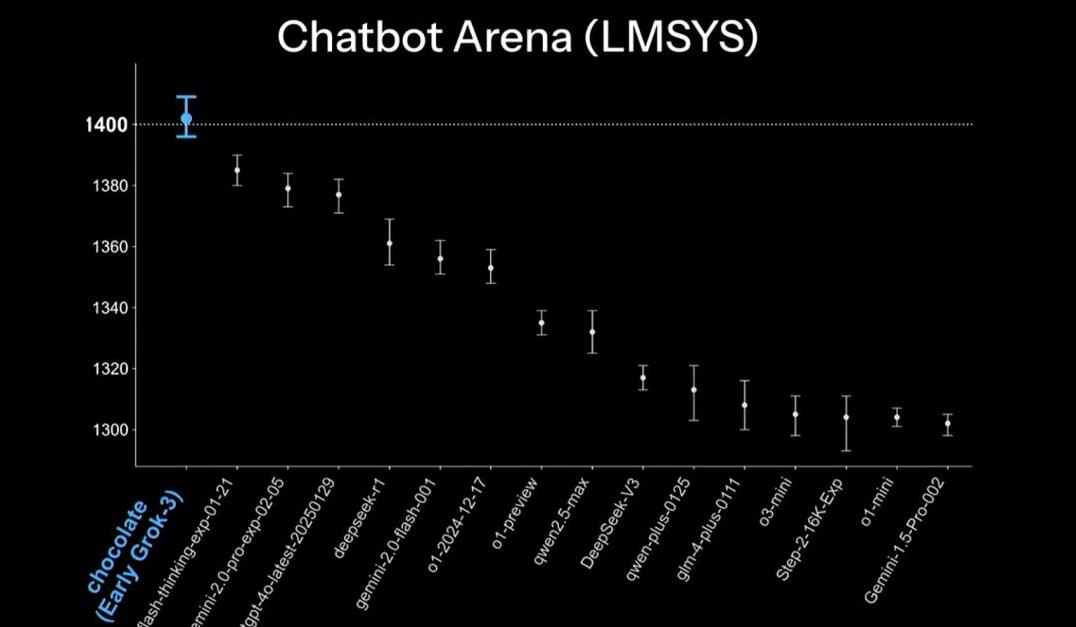

官方的测试结果给了我们一份大礼。

在数学测试AIME和博士级难度的物理、化学、生物学GPQA测试上,Grok 3轻松超越了各路劲敌,如Google的Gemini-2、DeepSeek V3、OpenAI的GPT-4o等等。

要知道,AI界的这些大模型也可是各个身怀绝技。

推理能力的新突破

可不要小看Grok 3的推理能力,xAI的工程师们可是煞费苦心。

据说,在一个月前,Grok 3的预训练才完成,他们几乎是日夜兼程地将推理功能整合进当前模型。

现在,xAI带来了两个版本的Grok 3推理模型,一个是“完整版”的Grok 3 Reasoning Beta,另一个是“迷你版”的Grok 3 mini Reasoning。

这些推理模型不仅有着强大的自我核实能力,而且在回答复杂问题时表现得相当出彩。

官方展示的基准测试结果显示,Grok 3在多个测试中均超过了OpenAI的o3-mini高版本,这可不是随便谁都能做到的。

你以为这就结束了?

远远没有。

Grok 3还支持DeepSearch功能,它可以扫描互联网内容和X平台上的信息,并提炼总结出有用的答案。

这相当于它不仅会“思考”,还能“浏览”网络,做个全能高手。

从10万到20万GPU的超大规模训练你可能会问,Grok 3这么厉害,背后有什么秘籍?

答案就是硬件支持和数据中心。

回到2023年7月,马斯克拉拢了DeepMind、微软、特斯拉的多位大咖,成立了xAI。

不久之后,xAI就推出了Grok-1大模型,引起不少关注。

但马斯克显然不满足于此,果断决定在数据中心上大做文章。

起初,媒体报道xAI使用了10万个GPU,打造了一台超级计算机Colossus。

但后来,马斯克觉得这还不够,又继续加码,把GPU数量翻了一倍,达到20万个。

这一规模在AI界绝对是凤毛麟角,难怪Grok 3的训练效果如此惊人。

其实,说到这儿,不得不佩服马斯克的魄力和执行力。

要在短短几个月内完成这项浩大工程,不仅需要钱,还需要团队的默契配合和顽强的执行力。

xAI的工程师们透露,他们仅用了122天就让前期的10万个GPU上线运行,随后又在92天内把GPU数量翻倍,这样的效率真是令人瞠目结舌。

Grok 3的实际表现及预期Grok 3在各种测试中的表现如何?

有位知名学者评价它的演示说,这次展示看起来颇为公式化,虽有些亮点,但创新不足。

而另一位AI大牛却打出了高分,他认为Grok 3甚至在某些方面已经领先于其他顶尖模型。

有专家在拿到Grok 3的早期使用权后表示,这款模型在处理复杂问题时表现得非常出色,尤其是在某些需要深度思考的任务上,Grok 3展现了非凡的能力。

比如,它能创建《卡坦岛》游戏网页,解答关于训练GPT-2的复杂问询,而这些都是其他模型难以胜任的。

不过,也并不是所有人都为Grok 3叫好。

还有些用户发现它在处理某些带有幽默感的问题时,会显得有些呆板,甚至在个别伦理问题上过于敏感。

不过,这些问题其实在当前阶段的AI模型中都很常见,并非Grok 3独有的弱点。

在人工智能这个竞争激烈的领域中,Grok 3能够在短时间内脱颖而出,已经足够令人惊叹。

而它的实际应用和表现,可能还需要更多的测试和时间去验证。

结尾回顾我们探索Grok 3的一路,能深刻感受到科技带来的震撼与挑战。

Grok 3不仅仅是一款强大的AI,更象征着马斯克及其团队在探索人类智能边界上所做的不懈努力。

就像Grok这个名字所传达的“深刻理解”一样,我们也许正处在认识人工智能真正潜力的起点。

未来,随着Grok的不断完善和发展,我们有理由期待更多的惊喜和突破。

不仅仅是在技术上,更是在AI如何更好地服务人类、解决实际问题上。

Grok 3已经迈出了一大步,下一步会是什么样?

或许,会比我们今天看到的更加令人兴奋。

让我们拭目以待,期待智能新时代的更多奇迹。