平时喜欢玩游戏、看3D动画片的朋友,肯定对“动作捕捉”这个词不陌生。

无论是游戏人物还是动画片角色,他们能够做出各种生动的表情,其实都离不开动作捕捉技术的加持。

不过,动作捕捉技术应用了这么多年,也不是没有缺点,比如动捕的工作流和需要的设备非常复杂,以200分钟左右的动画来看,从演员表演到最终完成往往需要不止一个月的时间。而且动捕的设备也非常昂贵,动辄就是几十万美金。

而除了动作捕捉,要想实现动画中的表情控制,可能就只有传统动画师手动去肝了,这条路不用说,更加费时费力。

那么,上面这两种途径之外,还有什么方法能更高效且低成本地完成表情、动作的捕捉和控制呢?

在如今这个智能化的时代,要回答这个问题,肯定绕不开一个词:AI。

刚好,最近字节跳动智能创作团队提出了一项X-Portrait2单图视频驱动技术,就让我们看到了新的可能。

X-Portrait2单图视频驱动技术,仅需要一张静态照片和一段驱动视频即可生成高质量、电影级的视频。

该模型不仅能保留原图的ID,还能准确捕捉并逼真迁移从细微到夸张的表情和情绪,呈现高度真实的效果。这无疑是为创作富有表现力、逼真的角色动画和视频片段提供了一种成本极低且高效的方法。

听起来似乎是很不错,那么它的实际表现又怎么样呢?IT之家最近获得了内部测试的机会,下面我们不妨先通过X-Portrait2的生成的视频表现来看一下。

X-Portrait2实测:看到这逼真的效果,感觉我起猛了……

实际使用时,我们只需要给模型提供一段带有显著人物表情的视频,以及另一张静态的人物照片,X-Portrait2就可以让照片中的人物做出和视频上人物相同的表情、动作。

比如IT之家首先想到影视经典乌蝇哥的名场面,然后让《黑神话:悟空》里的天命人来复刻乌蝇哥的表情(视频测试素材仅用于技术演示):

X-Portrait2技术下天命人模仿乌蝇哥的表情整体还是比较自然的,和原视频也比较像。而且可以看到测试图片中天命人和视频中的乌蝇哥头部视角是有差别的,但这并没有影响到X-Portrait2对表情的复刻。

接下来IT之家想到让游戏《生化危机4:重制版》中的里昂和艾什莉演绎电视剧《回家的诱惑》中的名场面,X-Portrait2同样生成了对应的视频,小编将结果专为gif格式,供大家参考:

由于是将真实人物的表情模拟到3D角色建模上,看起来难免会有一种怪怪的感觉,但能看到X-Portrait2已经是尽可能让生成的视频角色表情和画面整体看起来自然了。仔细观察会发现生成后的视频在原来静态图片的基础上加入了不少控制表情时面部阴影细节的变化,这都是为了让最终生成的效果更加协调和真实。

接下来再测试一个例子,让《荒野大镖客2:救赎》中的亚瑟・摩根做出《三国演义》电视剧里诸葛亮骂王朗的表情:

可以看到,这次生成的结果就更加逼真了,亚瑟做表情时,面部皮肤纹理、阴影细节的变化都非常真实,如果不仔细看或者不了解游戏剧情,真可能会以为这就是游戏里原来的CG动画。

前面都是用游戏中的人物做测试,接下来IT之家使用AI生成的人物照片来进行测试,这样就相当于真人照片来模仿原视频真人的表情,理论上结果应该会更加“难辨真假”。

小编首先用AI生成一张成年男性的照片,让其模仿电视剧《大宅门》里于和伟吐口水的名梗:

换用AI生成的真人照片后,效果确实是更加逼真了,除了人物大笑时面部褶皱的阴影稍微有点过,其他看起来都很自然,如果不仔细观察,确实很难发现这是AI生成的表情复刻视频。

然后小编又让AI生成一张女性的照片,让它模仿电视剧《甄嬛传》结局里甄嬛与皇后最后对峙里的一个小片段:

可以看到,X-Portrait2技术让照片中的女生对甄嬛说话时表情模仿地惟妙惟肖,可以看到电视剧里甄嬛说这句话时的表情还是比较克制的,面部微表情的变化也很细腻,对于复刻来说其实是比较有挑战的。但实际呈现的结果显然可以让人满意,将甄嬛此刻的威严很好地展现了出来。

除了这些,小编在体验过程中还测试了一些其他的案例,比如让《黑神话:悟空》中的二郎神说“在坐的各位都是垃圾”,这表情还是很魔性的:

还有AI生成的男生模仿金馆长的大笑,也很逼真,以后要想模仿这种一般人做不出来的大笑表情,自拍个照片就行了……

总体来说,字节跳动的X-Portrait2单图视频驱动技术着实给小编带来了一些震撼,仅从目前测试的效果来看,已经很强了,各种细微的表情都能复刻和拿捏,同时通过增加新的阴影和细节变化让视频画面整体达到协调自然的效果,很难想象随着这项技术进一步成熟和进化,会达到怎样的效果,或许以后真的会改变动捕乃至动画、特效行业吧。

出色效果背后,这些领先性的创新值得关注

看到X-Portrait2技术让人震撼的表情和动作控制能力,相信大家也会好奇字节跳动究竟是怎么做到的,这背后有哪些技术上的创新?

X-Portrait2是字节跳动基于前一代的X-Portrait创新条件扩散模型研究成果上进化而来的,将人像驱动的表现力提升到了一个全新的高度。

不同于以往依赖人脸关键点检测的单图驱动方法,X-Portrait2构建了一个当前最先进的表情编码器模型,通过一种创新的端到端自监督训练框架,能够从大量人像视频中自学习ID无关的运动隐式表征。进一步将这个编码器与强大的生成式扩散模型相结合,即可生成流畅且富有表现力的视频。

经过在大规模高质量表情视频上的训练,X-Portrait2在运动表现力和ID保持性方面显著优于先前技术。算法能够从驱动视频中提取不同颗粒度的表情特征(如挑眉、咬唇、吐舌、皱眉),并有效迁移到扩散模型,实现精准的表情动作控制,进而能实现驱动视频中人物情感的高保真迁移。

在训练表情编码器时,为了让编码器关注驱动视频中与表情相关的信息,X-Portrait2较好地实现了外观和运动的解耦。

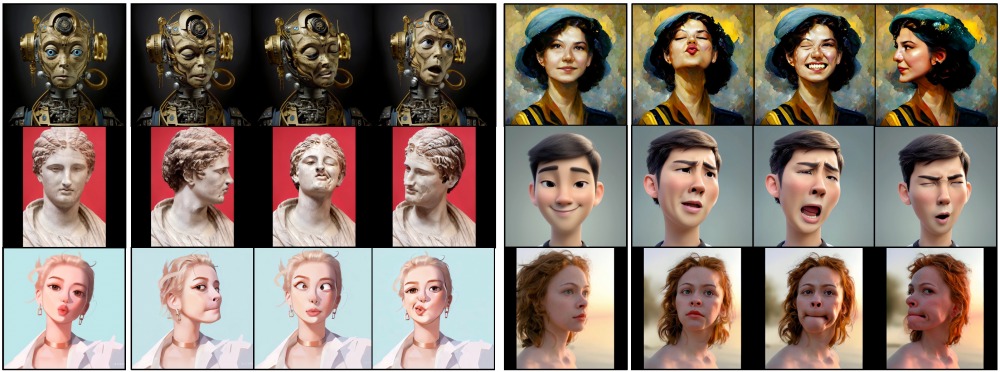

具体来说,通过为模型设计过滤层,编码器能有效过滤运动表征中的ID相关信号,使得即使ID图片与驱动视频中的形象和风格差异较大,模型仍可实现跨ID、跨风格的动作迁移,涵盖写实人像和卡通图像。这使得X-Portrait2能高度适应各种各样的应用场景,包括现实世界中的叙事创作、角色动画、虚拟形象以及视觉特效等。

正因如此,前面IT之家测试时即使驱动视频是真人影视剧片段,而ID图像是3D游戏建模人物,也能很好的视线表情动作的控制。

再比如下面这几个例子,驱动视频是真人视频,而ID图像有真人照片、卡通漫画,甚至是油画作品,X-Portrait2也输出了足以乱真的结果。

看到X-Portrait2的表现,可能有小伙伴会想到不久前由谷歌等公司支持的人工智能初创公司Runway推出的“Act-One”功能,集成在Runway的视频生成模型Gen-3Alpha中,这个功能也和X-Portrait2有类似,让用户可以使用手机或相机轻松录制自己或他人的视频,之后利用Act-One功能将录制对象的面部表情转移到AI生成的角色上。

而与RunywayAct-One等最先进的方法相比,X-Portrait2更加出色,能够如实表现快速的头部动作、细微的表情变化以及强烈的个人情感,这些方面对于高质量的内容创作(比如动画和电影制作)至关重要。

例如下面这组效果对比中,X-Portrait2相比X-Portrait对人物面部表情的刻画明显更加丰富和生动,而RunywayAct-One生成的人物面部缺少很多细节,看起来表情相对生硬,明显没有前两者有冲击力。

再比如下面这个案例中,驱动视频中的人物动作幅度较大,而且表情比较夸张,X-Portrait2很好地还原了原视频的特点,X-Portrait丢失了一些面部细节,而且头部运动的过程有些跳脱,但整体也不错。RunywayAct-One这边,则直接因为驱动视频头部运动幅度较大而无法生成。

由此可见,字节跳动X-Portrait2单图视频驱动技术在确实还是很猛的,包含很多创新点,而且无论是在动态目标捕捉能力,还是在生成结果的逼真度,协调度等方面,相比目前行业里其他类似的AIGC模型和方案都有明显的优势。

结语

体验并了解完字节跳动的X-Portrait2单图视频驱动技术,IT之家不得不感叹AIGC技术进步速度之快,以及字节跳动在AI模型创新方面强大的技术实力。

同时还要提醒大家,上面小编体验的还只是X-Portrait2内部测试的版本,而随着未来其模型技术的成熟完善,其应用前景无疑是不可限量的。

比如创作者们可以用它来大大加速自己的创作,过去需要投入大量人力物力的动捕设备,可能就不需要了,拍一段视频+1张照片,就能解决表情动作采集的问题,这种效率的提升简直不敢想象。

再比如这项技术未来也可以应用到数字人、XR等领域,让我们的数字分身或者各种AI智能体能够更像真人,甚至能够通过表情变化传达情绪,和我们进行更加自然的交流,进一步打破虚拟和现实的边界……

可以说,生成式AI的每一次进步,都是我们生产效率的巨大提升,更是对我们当前工作、生活和娱乐的变革。

而字节跳动们正在通过持续创新的技术和解决方案,一步一步让这样的理想变成现实。

生成式AI的未来,真的充满无限可能。