潮新闻客户端执笔黄心怡

都说“耳听为虚,眼见为实”,但在AI技术井喷的时代,你看到听到的一切可能都是假象。

11月9日,湖南公安通报一起AIGC(人工智能生成内容)诈骗案件。一位老人在手机营业厅进行视频通话,视频里有位身穿警服的男子称老人涉嫌违法犯罪,需要配合警方进行资金核查。神色慌张的老人正准备根据指引缴纳所谓“犯罪款项”,引起了巡逻义警的注意,这才阻止了一起诈骗。

其实,这是骗子利用警方在网上公开的照片、视频,通过AI换脸技术冒充“警察”而成的把戏。

如今的AIGC正在快速迭代,图片、音频、视频似乎无所不能。从“明显假”到“真假难辨”再到“以假乱真”,在泛娱乐内容当道的短视频平台,AIGC为网友们提供了情绪价值,但有些内容似乎“跑偏”了,还给不少人带来了困扰。

只需10秒,AI就能“偷走”你的声音

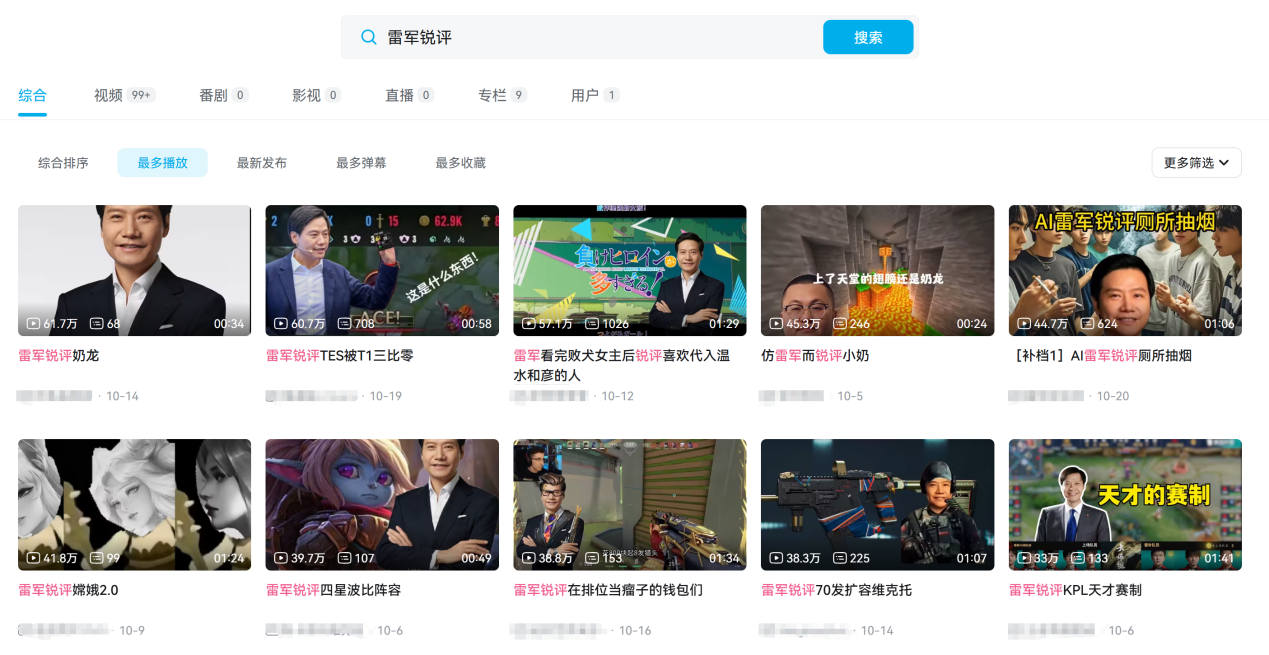

前不久,“雷军AI配音”相关视频在网络掀起风波。在网传视频中,小米公司创始人、CEO雷军的声音特征的语音内容“锐评”假期堵车、年轻人赖床、游戏外挂等话题。

如果仅仅是对热门话题的调侃或“心灵鸡汤”倒也罢了。部分AI配音视频用词较为过激,甚至还含有粗俗言论。有网友说“切换到每个软件都在被雷总追着骂”。

“雷军AI配音”相关视频

其实,这些发言和雷军本人并无干系,而是AI配音生成。记者搜索发现,目前市面上有大量AI配音的在线插件或小程序,用户只需选择相应的人物声音并输入文字,最快只需10秒,便可借用他人的声音发表言论。

有些软件甚至提供了更加“灵活”的创作空间,能克隆任何音色。在一个开源网站上,导入一段45秒内的人声音频用于训练模型。等待几分钟后,即可通过输入文字生成任意音频内容。

除了雷军,被“偷走”声音的公众人物还有不少。

今年9月底,一段据称是某直播平台老板卢某某的酒后录音在网络上流传,卢某某在录音里表现出对消费者的傲慢,以及对相关人士的不尊重,为该平台招致了不小的争议。

警方调查发现,音频系通过深圳某科技公司开发的模型伪造。嫌疑人上传卢某某此前直播片段的约30秒录音,就完成克隆,输入文本后生成网传视频。

“只需一段话,克隆任何声音”?记者在多个电商平台发现,有的网店或个人账号提供“AI克隆声音”的软件售卖或生成语音服务,标价在几元至几十元不等,支持方言和多种外语。

记者向其中一家店咨询,客服表示提供声音素材即可进行克隆,根据声线数量及生成音频字数(长度)综合收费,但不得商用。

不仅如此,AI变声的技术还可以进行实时转换。B站知名UP主、北京师范大学法律硕士周伟华(网名“第七翼刀”)就做过一期关于AI换脸、变声的实验视频。

在视频里,周伟华将自己的照片和音频通过AI进行训练,并邀请一位发型、口音和自己相仿的男性朋友,登录在线会议与自己的同学进行视频通话。在480P的画质里,“假脸”和“假声”几乎能做到音画同步,一招“瞒天过海”成功骗过对面的同学,也让评论区的网友大开眼界。

真人(左)和AI换脸后(右)对比。图源:B站UP主“第七翼刀”

AI玩过界可能涉嫌违法

“网友都喜欢有趣的内容,名人效应加热门话题的打法,很容易被算法推荐。”一位活跃在多平台的萌宠自媒体达人熙熙(化名)从创作者视角,给出了自己的看法。

熙熙说,自己在剪辑视频时为了增加戏剧性和互动性,也会使用AI配音给宠物“加戏”,让宠物用人类的口吻对话,“AI配音比较容易玩梗,视频数据确实好了很多。”

很多网友也表示,AI变声能够降低自己在视频里使用原声的“羞耻感”,再加上模糊五官和脸部轮廓的滤镜,“有种平静的疯感”。

被广大网友追捧的黄瓜特效

值得注意的是,很多软件为了规避影视作品版权风险,并不会直接使用声线的全名,而是代称。比如一款名为“配音蜂”小程序内置了“麦克阿瑟”“四郎”“顾姐”等上百种声音;剪辑软件“剪映”则内置了不同音色的“猴哥”、“云龙哥”“黛玉”等角色。有人表示,听多了AI配音再听角色原声“反而没那个味了”。

配音软件里的不同音色

配音软件里的不同音色

AI配音当然有存在的价值,但如果毫无底线地滥用,那些对AI技术不熟悉的中老年网民,很容易会以为是本人在发表言论和观点。

北京京师(杭州)律师事务所陈光文律师接受记者采访时表示,我国《民法典》已经把“声音权”统一到了“人格权”范畴,归入“肖像权”。未经许可使用他人声线进行商业利用或恶搞等不当行为,可能被视为侵犯肖像权,需承担相应的民事赔偿等责任。

当生成的AI语音内容包含对被模仿者的诋毁、污蔑等负面评价,足以致使其社会评价降低时,构成对名誉权的侵犯。未经授权使用像雷军这样的企业家、公众人物的声线,生成AI语音进行不当传播,可能会影响到其在商业合作、品牌价值等方面的商业利益,间接侵害了其商业权益。

日渐猖獗的AI诈骗,对个人信息保护、数据安全带来了新的挑战。2023年5月,全球知名安全技术公司迈克菲发布对来自7个国家的7054人进行了调查,其中四分之一的成年人受访者表示经历过AI语音克隆骗局,70%的人表示自己难以分辨出克隆声音和真实的人声。

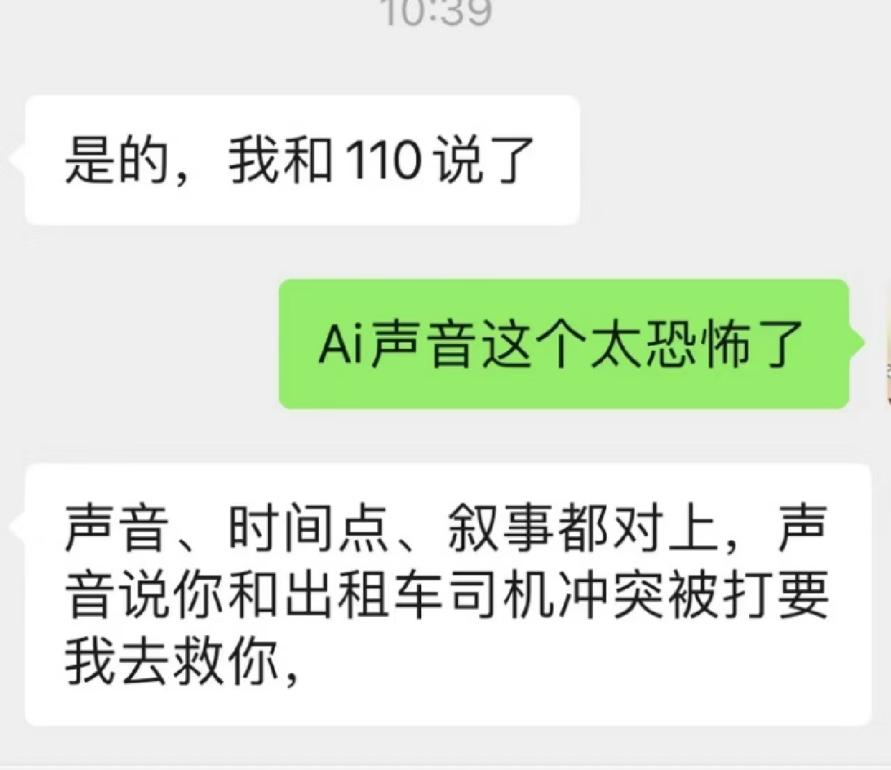

在上海工作的95后青年小方曾经历过这样的骗局。2023年7月,小方在打车前往浦东国际机场的路上,女朋友接到了自己号码打来的电话。电话里,小方的声音称自己在出租车上与司机发生冲突被绑架。女朋友吓坏了,但仍有警戒心,立刻换了手机号给小方打电话求证,才确认这是一场骗局。

“模拟的手机号和我的真实号码完全一致,因为前面加上了0086的区号,所以在女朋友手机里显示我的备注。”小方告诉记者,“最可怕的是骗子掌握的信息都是真实的,完全不知道是从哪泄露出去的。”事后,小方女朋友将此事报警。警方表示,以“00”“85”“95”“+”等开头的境外号码或虚拟号码很可能是诈骗电话,需要提高警惕,不要轻信电话里的内容。

小方的通话记录。图源:受访者

小方和家人的聊天记录。图源:受访者

如何消除AIGC引发的社会担忧

AIGC突破性发展,在传统行业、新兴行业都有着广阔的应用空间,但滥用行为带来的风险也引发了社会担忧。

2023年发布的《最高人民法院、最高人民检察院、公安部关于依法惩治网络暴力违法犯罪的指导意见》明确规定,对“利用‘深度合成’等生成式人工智能技术发布违法信息”的情形予以从重处罚。

法律界人士认为,避免AIGC违法犯罪产生更严重的后果,既需要平台健全内容审核机制、通过技术手段加以甄别,也需要强化用户引导,合法合规地使用AI进行创作。

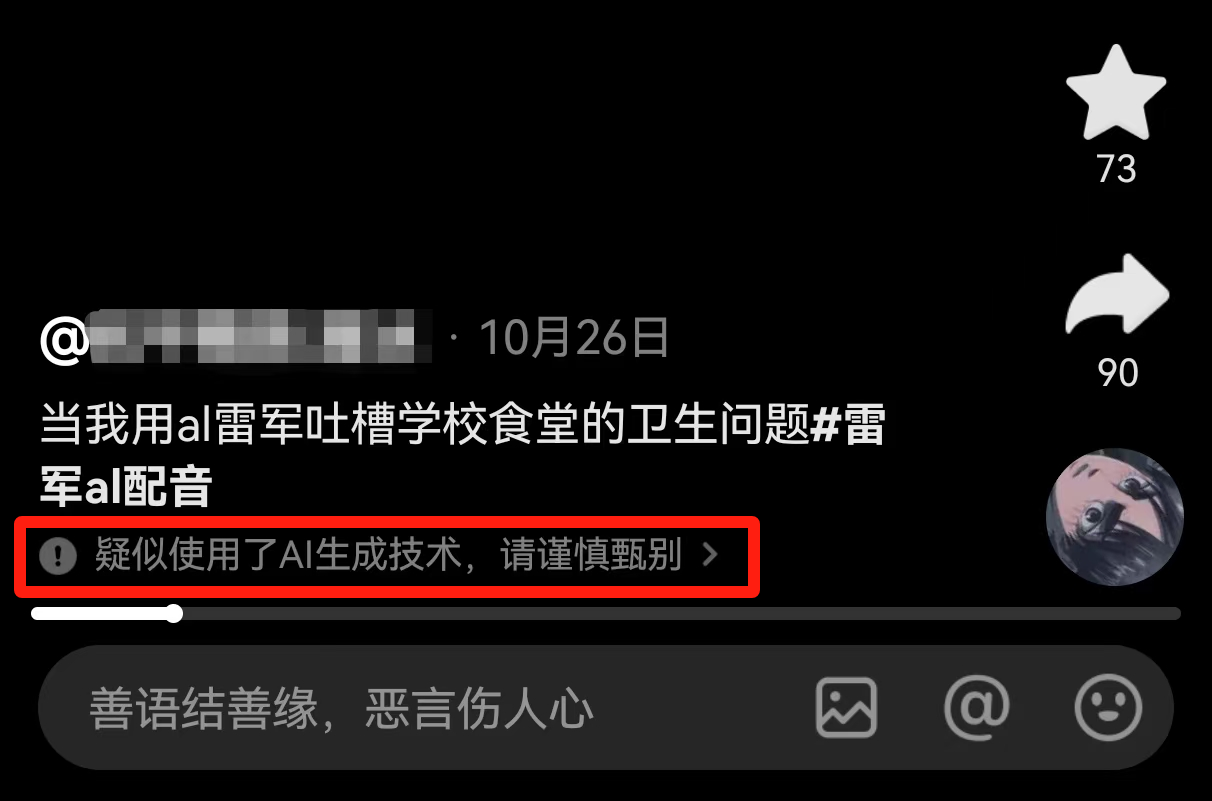

今年9月,国家网信办发布了《人工智能生成合成内容标识办法(征求意见稿)》,其中要求,通过人工智能生成的视频、音频、图片都必须加以明确的标识。这种通过信息披露实现的治理,无疑为广大网民擦亮了辨别的双眼。

记者搜索发现,许多互联网内容平台都已经在显著位置对AI相关内容给出提示。小红书表示,平台重视并支持AI等新技术创新,但不得侵害他人肖像权,禁止使用AI创作内容虚构使用体验或效果进行商业变现。抖音在对AIGC内容生成进行治理的同时发出倡议,使用统一的AIGC数据标准或元数据标准,便于其他内容平台进行识别。

多个互联网平台添加AIGC内容相关提示

为了从内容源头进行引导和规范,陈光文律师认为,内容平台应该通过技术与人工审核相结合的方式,加强AIGC相关内容的监管。此外,平台有责任向用户宣传知识产权保护、人格权保护等相关法律知识,告知用户内容侵权及违反公序良俗造成的后果,让AI内容更为规范。

当然,AI并不可能自行开展无秩序、无底线的内容创作,目前AIGC的导向仍牢牢把握在训练模型的人类手里。业内人士建议,应加强AI反制技术研究,“以AI制AI”,以“道高一丈”去对抗“魔高一尺”。

以AI合成声音为例,清博智能学研院副院长郝雅婕向潮新闻记者介绍,在波形分析中可以看出AI语音特殊的频谱特征,例如高频细节较少、自然噪声不足等。并且,AI语音的波形往往有较为平滑的过渡,真人语音的波峰和波谷则会更明显。

从直观的听觉感受来说,真人语音的节奏停顿会依语境情绪而改变,但AI语音可能会有一些断句不合理的地方,并且句子间没有明显气口。这样的感触在真人与AI语音对话时会有比较明显的感受。这些都可以成为我们鉴别真伪的方法。

“目前一些专业的语音分析工具可以用于辅助识别AI音频,但仍需要不断提高精度,以适应不断进化的AI合成技术。”郝雅婕认为,规范AIGC的道德和法律界限需要多管齐下。在不久的将来,如果能建立起相关行业标准,在生成内容中加入“AI标识”或数字水印,对完善网络内容治理、促进生成式人工智能技术健康发展有极大好处。

此外,一些科技公司正加强对AI图像的反制研究,在公安、金融的视频认证场景已有应用。甚至一些智能手机都搭载了deepfake(深度伪造)检测能力,能识别视频通话中的AI换脸,并弹出相关提示。

AIGC的主场,在当下,更在未来。持久的行业竞争将刺激内容平台参与者加快技术创新的脚步,裂变出更多可能。不论AIGC是用于娱乐还是创作,都需要为人类向好向善服务,才能实现行业的长足发展。

而对于广大网民来说,无论是听新闻、接电话还是刷视频,不妨多留一个心眼,“眼见不一定为实,有图不一定有真相”,冷静分析综合判断,必要时拿起法律武器保护自己的权益。