IT之家2月15日消息,IT之家从英特尔开发人员专区获悉,2025年首个OpenVINO版本(2025.0)于14日正式发布,本次更新聚焦性能提升、更多生成式AI模型的支持,并针对英特尔神经处理单元(NPU)推出关键优化。

官方表示:OpenVINO2025.0版本正式支持FLUX.1图像生成模型(含Dev与Schnell变体),可在英特尔CPU/GPU上通过GenAI流水线运行。开发者现可通过Optimum-Intel导出Flux模型,并结合Text2ImagePipeline生成图像。针对Flux模型对精度变化非常敏感的特点,我们进行了深度优化,确保图像生成性能与准确度兼得。

例如,INT8量化版FLUX.1-dev模型在应用Yarn风格LoRA前后的对比如下(提示词:"alberteinstein,yarnartstyle",初始种子=420,迭代次数=20):

此次还加入了Image2Image与Inpainting的支持。

Image2Image:以图像+文本为输入生成新图像,提升结果可控性;

Inpainting:通过掩码图像替换输入图像的指定区域,支持局部内容再生。

两种流水线均兼容LoRA适配器,满足定制化需求。

本次新版本在LLMPipelineAPI中引入了对提示词查找解码的预览支持,这是对推测解码的简化,它在输入提示词本身中用直接查找机制取代了传统的草稿模型。这有助于在具有高相似性的请求的情况下显著减少生成延迟。例如,通过对一组文档的问答可以观察到性能优势,因为答案将根据作为提示词本身一部分的文档来生成。

英特尔称目前正在努力支持和验证最新模型,包括Mistral-7B-Instruct-v0.2、Qwen2.5,“当然我们也支持基于LLama和Qwen架构的DeepSeek蒸馏模型。”

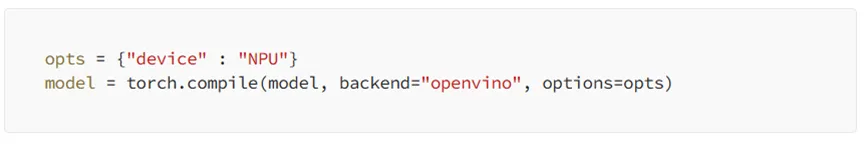

此外,2025.0版本首次实现NPU加速支持,开发者可通过PyTorch的torch.compile接口调用英特尔NPU算力。OpenVINO已经在CPU和GPU上得到支持,并且在性能方面非常接近原生OpenVINO推理。如下为启用方式: