编者按:

在上一期中关村在线《AI谈》栏目文章《AI行业“一石”激起千层浪!DeepSeek正撕开谁的“遮羞布”?》中,笔者阐述了一系列观点。其中,重点提及像DeepSeek这样的开源大模型,正凭借商业逻辑的变革,在AI行业引发一系列“连锁反应”。而就在这篇文章发布之后,DeepSeek迅速有了新动作,宣布启动“开源周”计划。按照规划,他们于本周已陆续开放5大核心代码库,由此引发的“DeepSeek效应”还在持续。

云大厂的狂欢,抢占DeepSeek流量红利

在这场DeepSeek制造的狂欢中,云大厂无疑是“排头兵”。据中关村在线不完全统计,微软Azure、亚马逊云科技、天翼云、华为云、硅基流动、腾讯云、阿里云。百度智能云、联通云、京东云、火山引擎、青云科技、移动云。无问芯穹、并行科技、中国电子云、国家超算互联网、UCloud等均已接入DeepSeek。为了抓住这波流量,纷纷卷起价格,甚至还送免费额度。

中关村在线观察到云厂商在接入DeepSeek时展现出一个不寻常的现象:它们不仅提供便捷的“一键部署”功能,还展开了激烈的“价格战”。这不禁让人好奇,这些云厂商是如何保持盈利的?中信证券的研究报告揭示,云厂商可以实现对DeepSeek等开源大模型的开箱即用,通过解耦大模型与GPU硬件的强绑定关系,打造高性价比解决方案,有望明显刺激行业上云及调用开源大模型需求,从而提升盈利能力。

尤为重要的是,DeepSeek显著提升了对于算力的需求。无论是在云部署、混合部署还是本地部署场景中,企业对于训练和推理的算力需求均急剧增加。有分析指出,随着国内领先的云计算公司纷纷接入DeepSeek,这将有力地推动云服务商在算力租赁及AI服务方面的收入实现快速增长。同时,DeepSeek开源模型所带来的低成本技术创新,有望进一步促进应用层面的繁荣,从而进一步推高云计算的算力需求。

争先恐后,硬件大厂押注大模型训推一体机

云厂商通过销售算力、服务和订阅模式盈利,那么硬件厂商又该如何在这个市场中分得一杯羹呢?对于那些对数据隐私有严格要求且智能化需求迫切的行业,如何满足其特定需求成为了一个关键问题。在这样的背景下,大模型训推一体机应运而生,成为了一种全新的解决方案。在大模型热潮席卷市场的相当长一段时间内,主流的AI大模型厂商、ICT服务商以及ISV服务商几乎无一例外地涉足到了大模型训推一体机的研发与制造中。

在这波DeepSeek掀起的AI浪潮下,这些企业也打造基于DeepSeek的大模型训推一体机。据中关村在线不完全统计,华为、中科曙光、优刻得、宏杉科技、优刻得、联想、云从科技、龙芯等企业均发布基于DeepSeek的大模型训推一体机。中关村在线认为,为了确保大模型技术成功落地,仅凭大模型自身的强大能力远远不够,还需克服实施流程及“最后一公里”应用的挑战。训推一体机作为关键策略之一,被广泛视为加速大模型在各行各业实践应用的有效解决方案。

在众多厂商竞相涌入的领域,大模型训推一体机的实际效能正面临严峻考验。首要挑战在于算力优化:DeepSeek需实现实时推理,这要求它不仅要减少机器使用、提升资源利用率和计算效率,还需加速推理过程。其次,工具的全栈化集成至关重要,这涉及到将专有数据、行业知识等融入模型进行微调,高效便捷的工具成为不可或缺的一环。最后,面对DeepSeek在各行各业快速落地的趋势,一体机必须克服“上线周期长、部署效率低”的难题。

即便未来DeepSeek的热度可能如GPT般逐渐减退,大模型训推一体机仍将作为推动大模型广泛落地的重要方案之一,持续发挥其关键作用。而考验大模型训推一体机能力的时代已经到来。

遍地开花,端侧AI迎来好的时代?

在当前大模型风靡的时代,手机、PC等硬件终端制造商纷纷布局端侧AI,催生了众多AI手机、AIPC等新兴产品,犹如雨后春笋般涌现。这一现象促使那些不具备强大计算能力的硬件终端开始运行参数规模相对较小的小模型。到底何为端侧AI?其实指的是不依赖于云服务器,能够直接在设备本地所运行的AI体验。与大模型训推一体机类似,端侧AI最大的优势在于隐私、可靠。

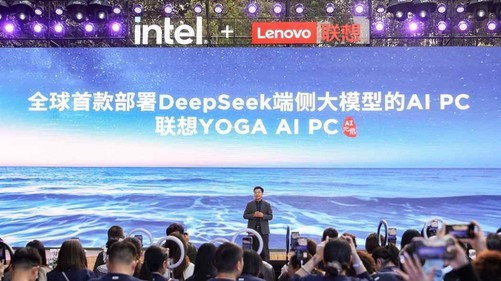

凭借开源优势及DeepSeek的推动,科技巨头正积极布局端侧AI,竞相抢占AIAgent入口,不仅限于手机、PC、眼镜,还涵盖机器人、玩具等广泛领域,预示着AI嵌入将引领硬件全面升级。甚至可以说,端侧AI作为AI技术的重要应用场景和下一代流量入口的关键,已成为行业竞争热点。

中关村在线也获悉,联想天禧个人智能体系统(天禧AS)迎来重大升级,联想就此成为全球首家在AIPC端侧本地部署和运行DeepSeek大模型的AI终端品牌。可以预见,随着终端芯片算力的持续提升,端侧模型能力不断增强,实时响应与隐私保护的需求也日益增长,这些因素合力加速了端侧AI的落地进程,使之成为现实。

写在最后

在当前大模型蓬勃发展的背景下,DeepSeek犹如一股春风,为产业链上下游注入了新的活力,惠及云厂商、算力提供商、硬件终端制造商以及端侧AI等领域。这标志着开源趋势带来的利好初现端倪,随着更多大模型的开源,围绕大模型的软硬件生态竞争日益激烈,进而推动整个大模型产业链蓬勃发展。

本篇为《AI谈》栏目的第二篇文章,而在下期文章里,笔者也将谈一谈“大模型引发的安全问题”。感谢大家阅读。