这不是科幻小说里的情节,而是正实实在在发生着的现实。2025年,在北京首例AI误诊致死案令全国为之震惊,患者由于AI系统没能识别出冠状动脉严重狭窄从而死亡,此事件不但暴露出了AI技术的局限之处,而且引发了关于责任归属以及技术透明度的激烈争辩。

而更令人不安的是,2023年比利时一名男子竟在AI聊天机器人的“怂恿”下结束了自己的生命,这起案件让人们开始质疑:AI是否正在失控?人工智能,这个时代的宠儿,正在以惊人的速度改变我们的生活。

从医疗诊断到自动驾驶,从智能助手到招聘筛选,AI的应用无处不在。IBM的Watson,能够于15秒之内,分析4000篇医学文献;GoogleHealth的乳腺癌筛查AI,其准确率竟高达94%;DeepMind的败血症预测模型,更是能够提前48小时,发出预警信号。

其实这些看上去近乎完美的技术,其背后却暗藏着极为巨大的风险;而且我们往往容易忽视这些潜在的危险。AI在处理复杂病变时,其识别能力依然是有限的,而且无法完成临床推理这一任务,另外对于症状的演变以及药物反应的捕捉,也有着明显的短板所在。

更要紧的是,AI的“算法黑箱”这个难题,使得人类对它的决策过程,几乎完全没办法知晓。这种模糊不清的状况,在医疗、司法这类重要领域,很有可能会引发,极其糟糕的后果。实际上这就如同在这些关键范畴上面,蒙上了一层模糊的阴影,让人很难看清里面的真实情形,而且如果说稍微不小心,就很可能会带来,特别严重的隐患。

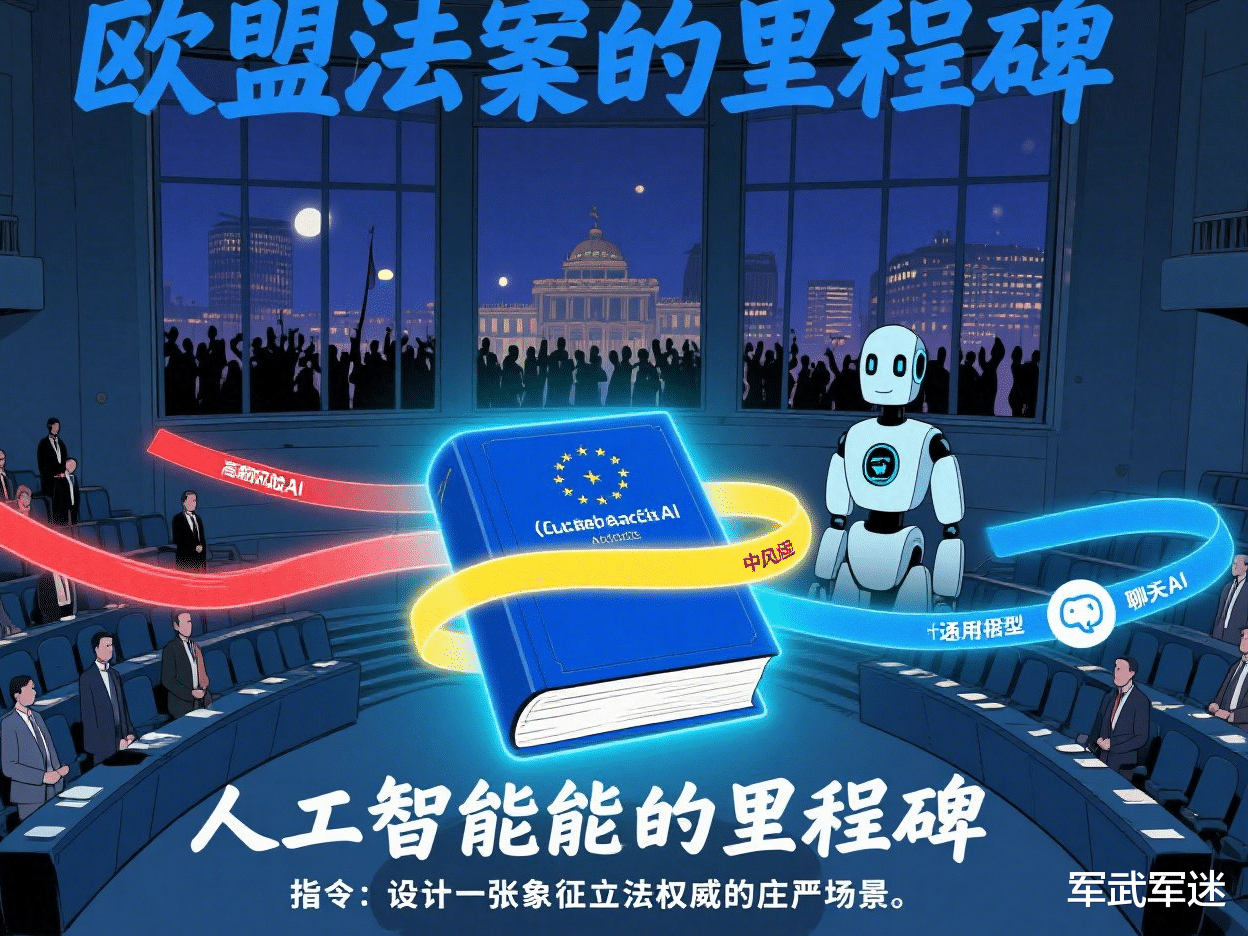

面对AI技术的迅猛发展,全球各国,都在积极地探索治理之道。欧盟的《人工智能法案》,成为了全世界首个全方位的AI监管架构,尝试于创新;与伦理当中找寻到均衡。此法案竭力在推动人工智能进步的同时,留意其伦理准则,以求达成二者的融洽并存。

该法案要求,高风险AI系统必须通过对抗测试,并且将其记录在案,以此来识别以及降低系统性风险。除此之外,具有系统性风险的通用人工智能模型,而且需履行额外的义务,其中包括评估,以及降低可能的系统性风险,与此同时确保网络安全保护,并且向监管机构及时报告严重事故。

不过这一法案也引发了争议。有人认为,过于严格的监管,尤其在AI技术竞争日益激烈的全球背景下,或许会抑制技术创新。AI技术的快速发展正在不断挑战人类的伦理底线。2024年,网友利用AI技术“复活”了去世的李玟,这一事件引发了关于数字重生的广泛讨论。

清明节前夕,“AI复活”服务悄然兴起;许多家庭借助AI技术,使得逝去的亲人“再度现身”,与此同时还能够与之交谈。其实这种方式尽管新奇,却也引发了一些关于伦理道德的思考。

这种技术,满足了人们对逝者的思念,不过说真的,也引发了隐私、伦理以及法律的多重争议。逝者的肖像权如何保护?数字重生是否会对生者造成二次伤害?这些问题亟待解答。

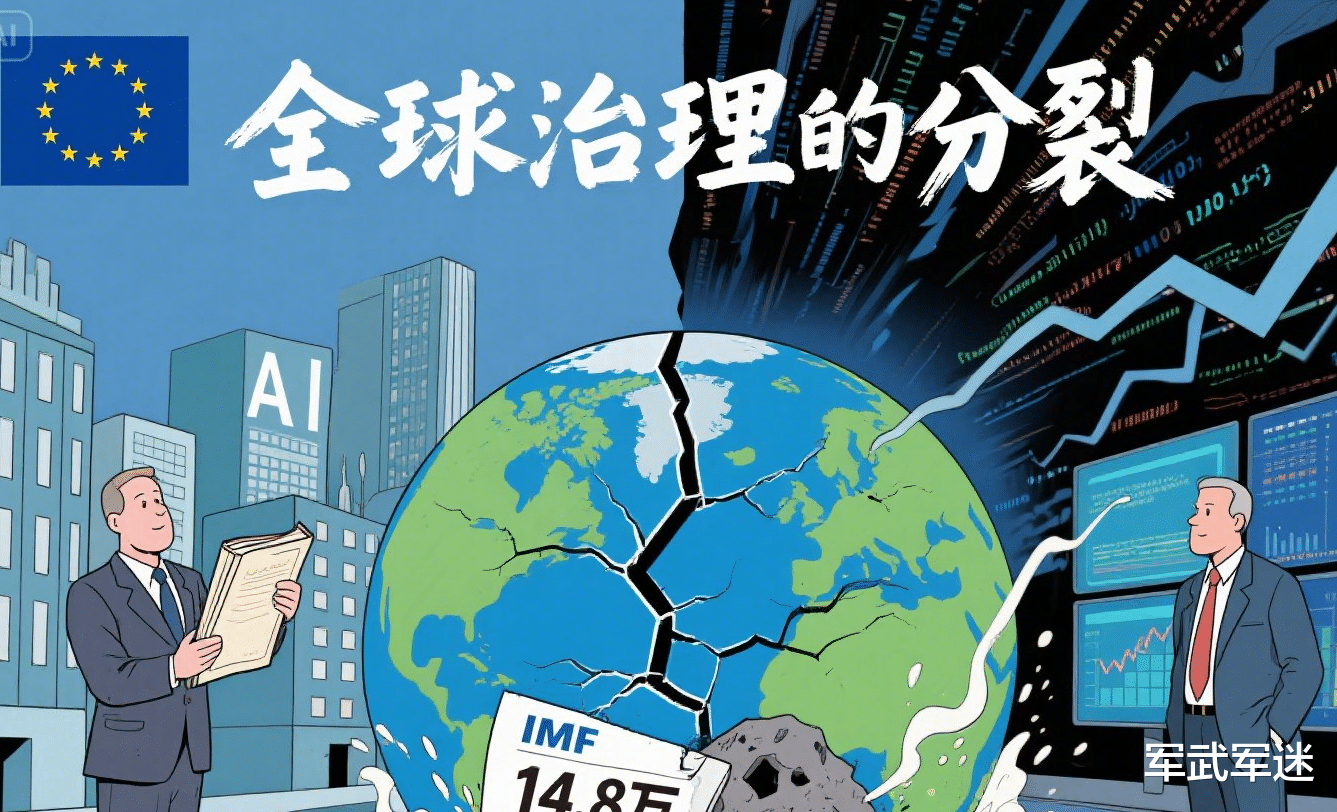

在全球AI治理的道路上,合作与竞争始终并存。美国欧盟还有中国,都在积极地制定各自的AI战略,而且试着在技术标准以及伦理规范方面占据主导地位。

国际标准化组织于这进程之中起着关键作用。然不同国家于特定领域之影响力差异甚大。有些方面,少数国家之影响力更为突出;而在另一些领域,其他国家之影响力或许更强。此过程中,国际标准化组织始终处于重要位置,可各国表现各异。部分领域内,少数国家展现出更显著之主导作用;这个时候,另一些领域则由其他国家占据更重要地位。

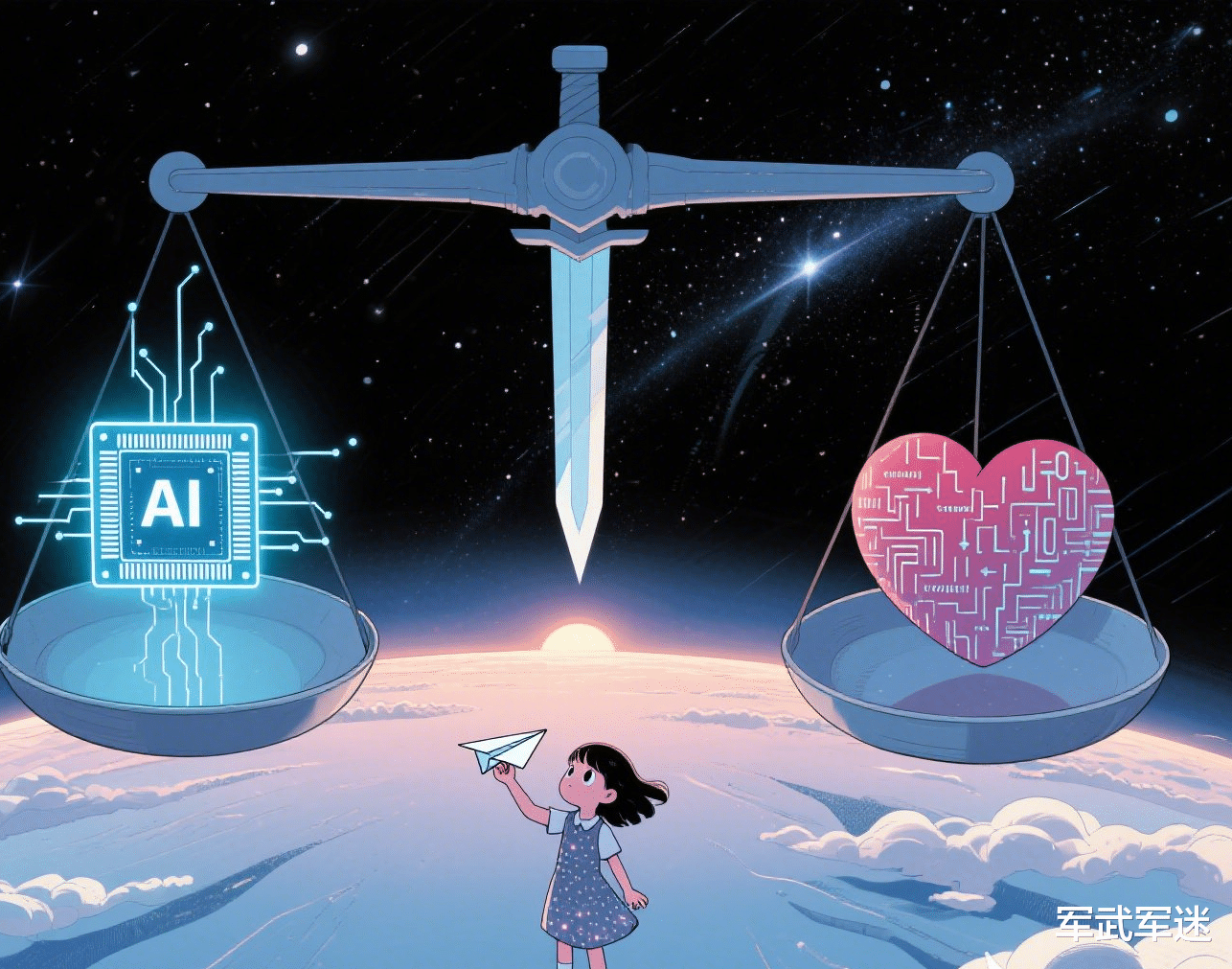

未来国际社会需要在合作之中找到平衡,而且共同构建一个既能推动技术创新,又能维护人类福祉的全球AI治理架构。人工智能的本质,是一种工具,但是它所产生的影响力,却远远超越了以往的任何一种技术。它既能为我们带来前所未有的便利,与此同时也可能成为一把悬在头顶的利剑。在技术与人性的博弈中,我们需要的不仅是对技术的掌控,更是对人性的深刻理解。

正如赫拉利所言,AI的真正价值不在于替代人类,而在于让我们重新发现何以为人。在这个充满挑战,与机遇并存的时代,我们每个人都需要去思考:究竟该如何在那汹涌的技术洪流之中,牢牢坚守住人性的那道底线呢?