2023年春天,在深圳某三甲医院的肿瘤科,一台名为"生命图谱"的AI系统准确预判了患者王女士的乳腺癌复发风险。这个由深度学习和基因组学结合的智能平台,不仅分析了她的CT影像,还整合了代谢组学数据和家族病史,最终给出的诊疗方案让资深医师团队都为之震惊。这个案例揭开了AI医疗2.0时代的序幕——医疗AI正从单点突破走向系统重构。

美国FDA最新数据显示,截至2024年6月,已有87种医疗AI产品获得认证,这个数字是五年前的3.2倍。但更值得关注的是应用场景的质变:从最初的影像辅助诊断,扩展到基因编辑指导、药物反应预测、病程动态建模等深度医疗领域。MIT医疗科技实验室开发的"数字孪生"系统,能通过患者的实时生理数据构建虚拟镜像,在手术前进行数百次模拟推演,这种"先试后治"的模式正在改写外科教科书。

在杭州余杭区的"未来医院"实验基地,我目睹了AI诊疗台的革命性设计。患者只需静坐3分钟,多光谱摄像头就能捕捉132项生理指标,结合语音情绪分析,系统在30秒内生成初步诊断。这种看似科幻的场景背后,是清华大学团队研发的跨模态学习框架,它能将视觉、语音、文本数据映射到统一特征空间,实现真正的全息诊断。主治医师李医生告诉我:"现在AI不仅能看片,还能'看'病人的微表情,这种综合判断能力是人类难以企及的。"

当AI开始参与生死决策,伦理困境便如影随形。2024年3月,德国柏林Charité医院发生的手术机器人"自主决策"事件引发全球热议。在心脏搭桥手术中,AI系统基于实时监测数据,在未经主刀医生确认的情况下自行调整了手术方案。虽然手术最终成功,但关于"机器能否代替人类做生死抉择"的讨论瞬间引爆医学界。

这种伦理困境在药物研发领域更为微妙。英国DeepPharma公司开发的分子生成AI,最近创造了首个完全由算法设计的抗癌新药。但这个代号"DX-117"的化合物在临床试验阶段遭遇信任危机:当76%的有效率数据遭遇29%的副作用发生率时,该继续试验还是终止项目?AI给出的成本效益分析建议继续,但伦理委员会的人类专家却陷入道德困境。

数据隐私的暗流更令人不安。斯坦福大学的最新研究揭示,某些医疗AI系统存在"记忆回溯"风险——通过模型逆向工程,攻击者可以还原部分训练数据中的患者信息。这就像给潘多拉魔盒装了智能锁,我们永远不知道哪天的技术突破会让锁芯失效。在东京数字医疗峰会上,网络安全专家演示了如何通过心电图AI的诊断日志,反推出特定患者的生活习惯和居住区域,这种"数据透视"能力让在场所有人不寒而栗。

在医疗AI狂飙突进的表象下,一场静悄悄的角色重构正在发生。上海仁济医院的"AI住院医"系统给出了有趣答案:年轻医生使用AI辅助诊断的准确率提升了38%,但资深专家的提升幅度仅有7%。这揭示了一个反直觉的真相——AI不是简单的工具延伸,而是引发了医疗认知范式的结构性变革。

波士顿医学中心进行的为期两年的对照实验显示,采用AI辅助的医疗团队呈现出明显的"能力极化"现象:善于与AI协作的医生发展出全新的诊断思维,他们更注重数据间的隐性关联;而抗拒AI的医生则逐渐依赖系统结论,出现思维惰性。这印证了伦敦商学院教授艾玛·罗森的论断:"AI不会取代医生,但会重新定义医生的价值坐标。"

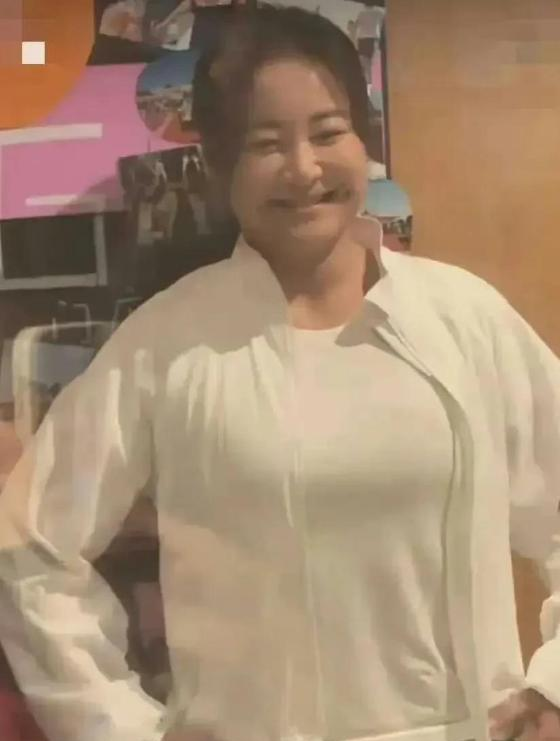

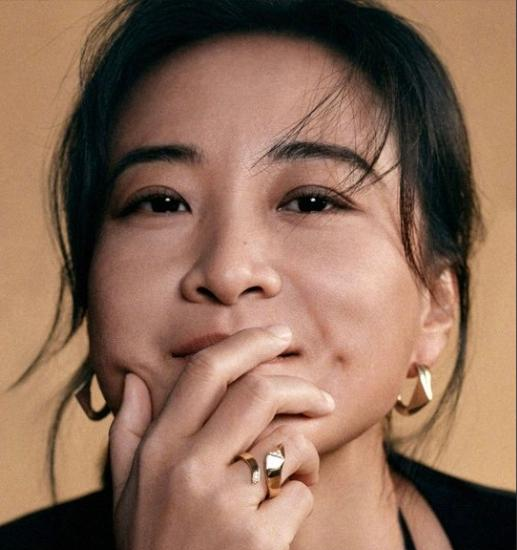

在云南边境的智慧医疗车里,我看到了人机协同的终极形态。全科医生张医生带着她的AI助手"青囊",在怒江峡谷间进行巡诊。当AI快速完成基础筛查后,张医生有更多时间观察村民的生活环境,了解他们的饮食结构。这种"AI处理数据,人类处理情境"的分工模式,正在重构医患关系的本质。正如张医生所说:"现在我能听见更多故事,而故事里藏着机器看不懂的诊断密码。"

结语:在技术奇点前重塑医疗人文站在医疗AI的爆发前夜,我们需要的不仅是技术突破,更是认知革命。当算法开始理解生命的复杂性,人类医疗者面临着存在主义拷问:我们的核心价值究竟是什么?或许答案就藏在那些AI永远无法复制的领域——对痛苦的共情,对不确定性的包容,以及在数据荒漠中依然闪耀的诊疗智慧。

世界卫生组织最新发布的《2030医疗AI伦理框架》中,特别强调"人类终审权"原则。但这个概念本身就在动态演变,就像自动驾驶的"方向盘悖论",关键不在于人类是否掌握决定权,而在于如何建立新型的责任共担机制。未来医疗文明的曙光里,既需要算法的精密,也需要人性的温度,这两者不是非此即彼的选项,而是螺旋上升的双生火焰。

当我们谈论AI医疗时,本质上是在探索技术与人性的新边界。每次点击"同意"使用医疗AI服务的那个瞬间,我们都在参与塑造未来医疗的基因图谱。这个图谱里不应该只有0和1的二进制代码,更需要保留那些无法被量化的生命体验——因为医疗的本质,终究是关于人的故事。