四年前,韩国发生了一起震惊世界的“N号房”事件,赵博士等人在网络上建立多个秘密聊天群组,将被威胁的女性作为性奴役对象,并在群组内共享非法拍摄的性视频和照片。

当时,此事闹得沸沸扬扬,既震惊于事件的恶劣程度,又惊叹于观众数量之多,有26万人订阅群组间接成为加害者。如今,四年过去了,韩国频发性丑闻事件有得到改善吗?

AI换脸

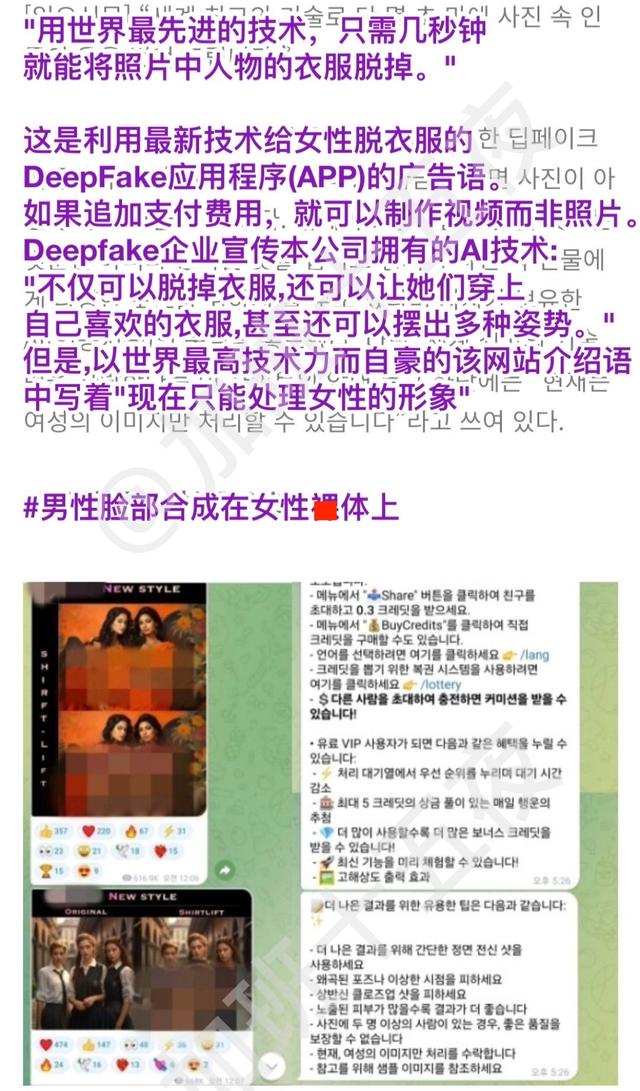

最近,韩国又曝出了一桩令人作呕的丑闻——AI“换脸色情”。一名韩国女生发文表示,有不法人员利用AI换脸技术,将女性照片制造deep fake并戏弄女性的事件。

什么叫deep fake?简单点来说就是一种深度伪造技术。在人工智能的加持下,这种技术可以实现语音模拟、人脸合成、视频生成等功能,可以达到以假乱真的程度。

还记得在今年2月,香港某公司被诈骗两亿港币,不法分子用的就是这种技术。

如今,随着技术不断提升,就连普通人也可以运用这种技术,有些坏人就打起了女性的主意。

根据网友爆料,韩国有多所学校多位女生因deep fake成为受害者。从小学到高中到大学,有人用熟人的头像或照片制造deep fake并戏弄女生,例如一键脱衣,把色情女星的脸部换成熟人的。

小女生哪经历过这些,当看到自己的不雅照片在网络上大肆传播,就连想死的心都有了。

如果说N号房主要犯罪是偷拍,而这一次的犯罪手段是非法合成。

两者有一个共同点,都是在电报群组里完成的。当订阅者将女学生的照片发到群里,并支付一定费用,群主便会用AI将女学生的脸部照片处理成色情图片。

偷拍需要找目标,还需要购买设备,有被抓到的风险。而非法合成只需要坐在电脑前,敲几下键盘就能完成。网上美女照片一大把,一键脱衣、一键换脸比看小视频还过瘾。

太恶劣了,这妥妥就是第二个N号房事件,再次刷新了大家对人性丑恶的认知。

据了解,群组订阅人数已经达到了22.7万,已经快赶上当年N号房的参与人数。有媒体将此事形容为第二个“N号房”,以笔者看简直是过犹不及,影响范围更广,事件也更加恶劣。

技术没有错,可恶的是那些利用技术心怀不轨的人,对那些无辜的人的面容进行肆意篡改,制作出不堪入目的色情内容。这是多么丧心病狂的行为。

这种行为不是科技的进步,而是道德的沦丧,是对人性的亵渎。

想想那些受害者,她们可能只是在正常地生活,正常地分享自己的照片或视频,却没想到会被这些恶魔拿去当成满足私欲的工具。她们的名誉受损,生活被搅得一团糟,这公平吗?

随着事件被闹大,韩国相关部门却选择冷处理,这更加激起了女性的愤怒。眼看在韩国境内得不到关注,有韩国网友另辟蹊径在中国媒体上发声,一下就引爆全网。

在此,我们强烈呼吁韩国政府赶紧行动起来,加大对这种非法行为的打击力度,制定更加严格的法律法规,让那些妄图钻空子的人无处可逃。

同时,还要加强对网络技术的监管,从源头上杜绝这类技术被非法滥用。投入更多的资源用于技术研发,以识别和防范这种深度伪造的内容。

最后,笔者呼吁我们每个人也要增强自我保护意识,不轻易在网络上泄露个人信息,不给这些恶魔可乘之机。让我们携手,共同抵御这股邪恶的浪潮,守护我们心中的那片净土,还社会一个清明与安宁。