和结构预测中的效率。

LLM摘要的影响

本文研究了LLM摘要在减少错误链接方面的效果。错误链接分为两种类型:误报和漏报。误报分为两个子类型:由参数引起的误报和由类型引起的误报。本文方法在减少由参数引起的误报方面表现最佳,对FCC数据集的减少约为90%。相比之下,本文方法在减少漏报方面表现较差。本文方法的有效性受到表达风格差异和缺乏必要细节的影响。与LLM改写相比,LLM摘要在所有数据集上都表现更好。

消融分析

两步流程

通过剖析执行步骤的效果,发现第二步的全局信息扩展对于提高摘要质量更为重要,特别是在FCC数据集中。将两个步骤合并成一个步骤会导致性能下降,说明将多目标任务分解成多个独立步骤是必要的。文章还提供了错误分析和生成摘要长度的比较。

GPT-4在CDECR上的表现

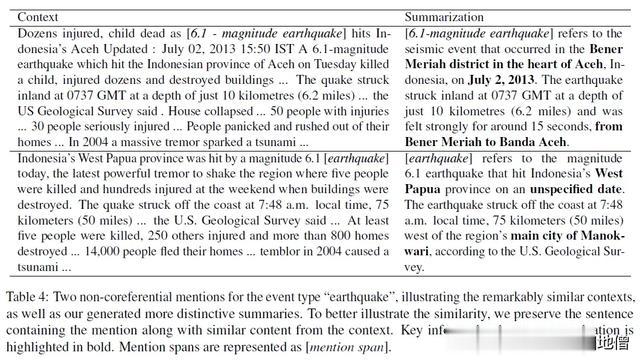

结果表明,使用少量示例学习和包含提及的句子作为上下文的方法(FewMIS)可以使GPT-4达到最佳性能,但仅能达到与基于词形匹配的方法相当的结果。同时,使用全文本作为上下文会导致性能显著下降。此外,零样本学习表现出更高的召回率但显著较低的精度。研究还发现,GPT-4在区分相似但非指代性事件方面存在局限性,而在基于语义的显著叙述差异的指代性事件方面也存在困难。

总结

我们设计了通用任务,以利用LLM在CDECR中的潜力,有效地弥合了LLM的通用功能与特定IE任务的复杂注释之间的差距。结果表明,通过利用LLM固有的知识和理解能力来更深入地理解事件,我们的协作方法可以减轻LLM对复杂上下文理解的挑战,最终提高性能。