小王最近非常兴奋,他在公司内部部署了最新的AI模型DeepSeek R1。

这个模型据说能提高工作效率,降低成本。

可是,没过多久,他的电脑和公司服务器就频频出现问题,甚至数据还莫名其妙地丢失了。

这下,小王才意识到问题的严重性,赶紧找来IT部门来查原因。

其实,小王的情况并非个例。

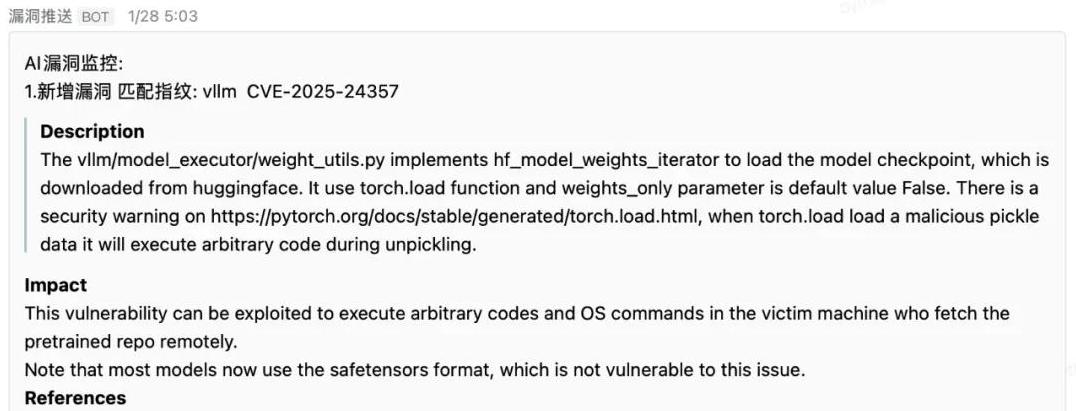

越来越多的人和企业开始使用DeepSeek并选择本地化部署,但是这种便利的背后隐藏着一些不容忽视的安全隐患。

今天,我们就来聊聊这些本地化部署中存在的风险,希望读者们能有所警惕。

我们先来看看Ollama,这是一个非常受欢迎的开源应用程序,用来在本地部署和操作大型语言模型。

虽然它在某些方面非常方便,但如果使用不当,安全问题也跟着来了。

Ollama的一个主要问题是它在默认设置下会开放11434端口,并且没有任何鉴权措施。

什么意思呢?

这意味着攻击者只要扫描到这个端口,就能通过接口删除模型、窃取数据,甚至使用你的计算资源。

这种开放性在方便用户的同时,也给了黑客们机会。

去年,Ollama爆发过一次严重的远程命令执行漏洞,代号CVE-2024-37032,这个漏洞影响了很大一部分用户。

尽管官方建议大家升级到最新版,但缺乏鉴权方案仍然是一个巨大的隐患。

OpenWebUI漏洞:怎样避免成为攻击目标再来聊聊OpenWebUI,这也是一个非常流行的大模型对话webui。

用户可以通过它进行大模型聊天、图片上传等多种操作。

这一听就很实用,可它的安全问题也不少。

例如,OpenWebUI曾经爆出一个编号为CVE-2024-6707的漏洞。

这个漏洞允许攻击者通过上传文件的方式,将包含路径遍历字符的文件名上传到任意目录。

这样一来,攻击者就可以将恶意模型文件上传,并通过反序列化操作来执行任意代码,严重的话甚至会控制你的设备。

为了避免成为攻击目标,最直接的方法是及时升级到最新版,并且尽可能避免开启用户系统。

此外,设置一些基本的访问保护措施也十分必要,这样至少能降低被攻击的风险。

ComfyUI的安全隐患不容忽视说到ComfyUI,它在市场上有着非常不错的口碑,尤其以文生图、文生视频的高定制化功能著称。

可惜的是,安全问题依旧是挡在用户和技术创新中间的一道坎。

ComfyUI的插件生态非常丰富,但这些插件大多来自个人开发者,他们对安全性关注不够。

这就给了一些恶意攻击者可乘之机,能够通过插件漏洞执行远程命令,甚至读写任意文件。

事例之一就是腾讯朱雀实验室发现的多个核心代码漏洞。

鉴于ComfyUI的漏洞修复速度较慢,甚至最新版本仍存在一些未填补的漏洞,大家最好不要将其直接暴露到公网使用。

这不仅是对自己负责,也是对公司的数据安全负责。

AI-Infra-Guard:你的AI基础设施安全守护者说了这么多漏洞,不少人肯定会问:那怎么办?

难道我们就不在本地部署AI模型了吗?

别急,其实已经有一些解决方案可以帮助大家提高安全性。

AI-Infra-Guard就是专门为AI组件而开发的一款安全工具。

它不仅支持检测常见的AI应用,还能自动积累和更新漏洞规则,做到实时监控。

使用起来也很便捷,只需要简单的命令行操作,就能对本地和公网开放的端口进行安全检查。

例如,小王这次正是通过使用AI-Infra-Guard来检测自己本地的AI组件,才发现了那些隐藏的风险。

这个工具不仅能给出安全建议,还能帮助开发者和运维人员更快地检测部署的AI服务的安全性。

特别是对于个人用户,AI-Infra-Guard更是不可或缺的一环,简直就是大家的安全小助手!

回到小王的故事,通过这次经历,他明白了一个重要的道理:科技在带来便利的同时,安全也是绝不能忽视的一个方面。

尤其是对于AI这种新兴技术,更应该多加防范。

毕竟,只有在确保安全的前提下,技术的进步才能真正发挥它的光彩。

在此,我想提醒大家,无论是个人还是企业,在使用AI工具时都要时刻注意安全问题。

及时更新版本、设置访问保护、使用专门的安全工具,这些看似简单的步骤却能起到很大的作用。

希望大家都能吸取小王的教训,避免类似的危险情况发生。

最终,技术的发展离不开大家的共同努力和警惕。

让我们一起,在追求科技进步的道路上,时刻保持安全意识,不断前进。

这样,AI才能真正地为我们的生活带来更多的便利与美好。