Wan2.1是阿里巴巴在2025年2月开源的一个多模态视频生成模型,它是通义系列AI的重要组成部分。该模型专注于视频生成领域,并实现了多项技术突破,旨在通过开源促进技术的普及和应用。

以下是Wan2.1的一些核心特点:

技术架构:采用了自研的时空变分自编码器(Wan-VAE)与扩散变换器(DiT)架构,能够支持任意时长1080P视频的无损编解码,同时保留完整的时序信息。此外,通过参数共享机制和动态图变换器设计来降低训练成本,提高生成效率。

核心能力:Wan2.1能够执行多种任务,包括文本到视频(T2V)、图像到视频(I2V)以及视频编辑等。它也是全球首个原生支持中英文文字特效生成的视频模型,可以生成短文本的动态效果,如书法文字逐笔浮现。物理模拟功能可以精确地重现复杂的物理规律,使得生成的视频效果接近实拍。

性能优势:在VBench评测中,Wan2.1以86.22%的总分超越了其他如Sora、Luma等模型,尤其在运动连贯性和细节还原方面表现突出。

版本与部署:提供了不同参数规格的版本,其中14B版本适合专业级GPU,而1.3B版本则对消费级硬件更加友好,仅需约8.19GB显存即可运行。采用Apache 2.0开源协议,允许商业使用且生成内容版权归开发者所有。

Wan2.1适用于影视特效、广告创意、短视频制作等领域,简化了复杂场景的生成流程,降低了专业级视频制作的门槛。

安装:

我已经将wan2.1和秋叶大佬的comfyui整合到一起了,10g显存以下可用,无需再下载wan2.1模型

链接地址:

通过网盘分享的文件:ComfyUI-aki-v1.6.zip

链接:

https://pan.baidu.com/s/1JLB_Nn_7ARJ1A4HSGJX5rA?pwd=iazm 提取码: iazm

若是拥有10g以上显存想要其他模型,按照以下链接自行选择

一、diffusion_models模型:(模型下载到根目录:

ComfyUI-aki-v1.6\ComfyUI\models\diffusion_models)

地址:

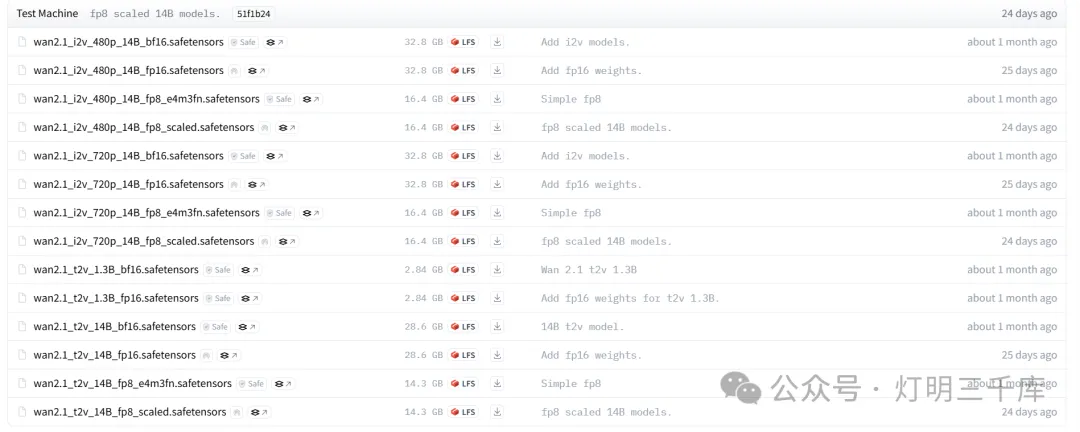

(每个模型生成质量从高到低:fp16 > bf16 > fp8_scaled > fp8_e4m3fn)

I2V=Image To Video=图生视频

T2V=Text To Video=文生视频

文生视频:显卡显存10g以下或更低,使用t2v 1.3B的fp16精度模型

图生视频:显卡显存10g以下或更低,使用GGUF

【显卡显存12g或更高】

使用i2v 480p fp8精度模型,t2v 14B fp8精度模型

【显卡显存16g或更高】

使用i2v 720p fp16精度模型,t2v 14B fp8精度模型

【显卡显存24g或更高】

随意使用

【建议】可以追求高分辨率但是不需要高精度,区别不是很大但是高精度生成速度很慢

GGUF版本:

GGUF地址:

4g显存:可以挑战Q3_K_S

6g显存:,用Q3_K_S或挑战Q3_K_M

8g显存:,用Q3_K_M或挑战Q4_1

显卡显存12g或更高,也建议使用GGUF的Q6K或者Q8_0

二、Clip Vision地址:(下载到

ComfyUI-aki-v1.6\ComfyUI\models\clip_vision)

地址:

Clip Vision我已经下载到网盘里无需额外下载

三、Text encoder:(下载到

ComfyUI-aki-v1.6\ComfyUI\models\text_encoders)

地址:

两个模型均在网盘里,无需额外下载

四、VAE:(下载到

ComfyUI-aki-v1.6\ComfyUI\models\vae)

地址:

模型已下载,无需额外下载

工作流示例:

通过网盘分享的文件:工作流

链接: 提取码: 6iyi