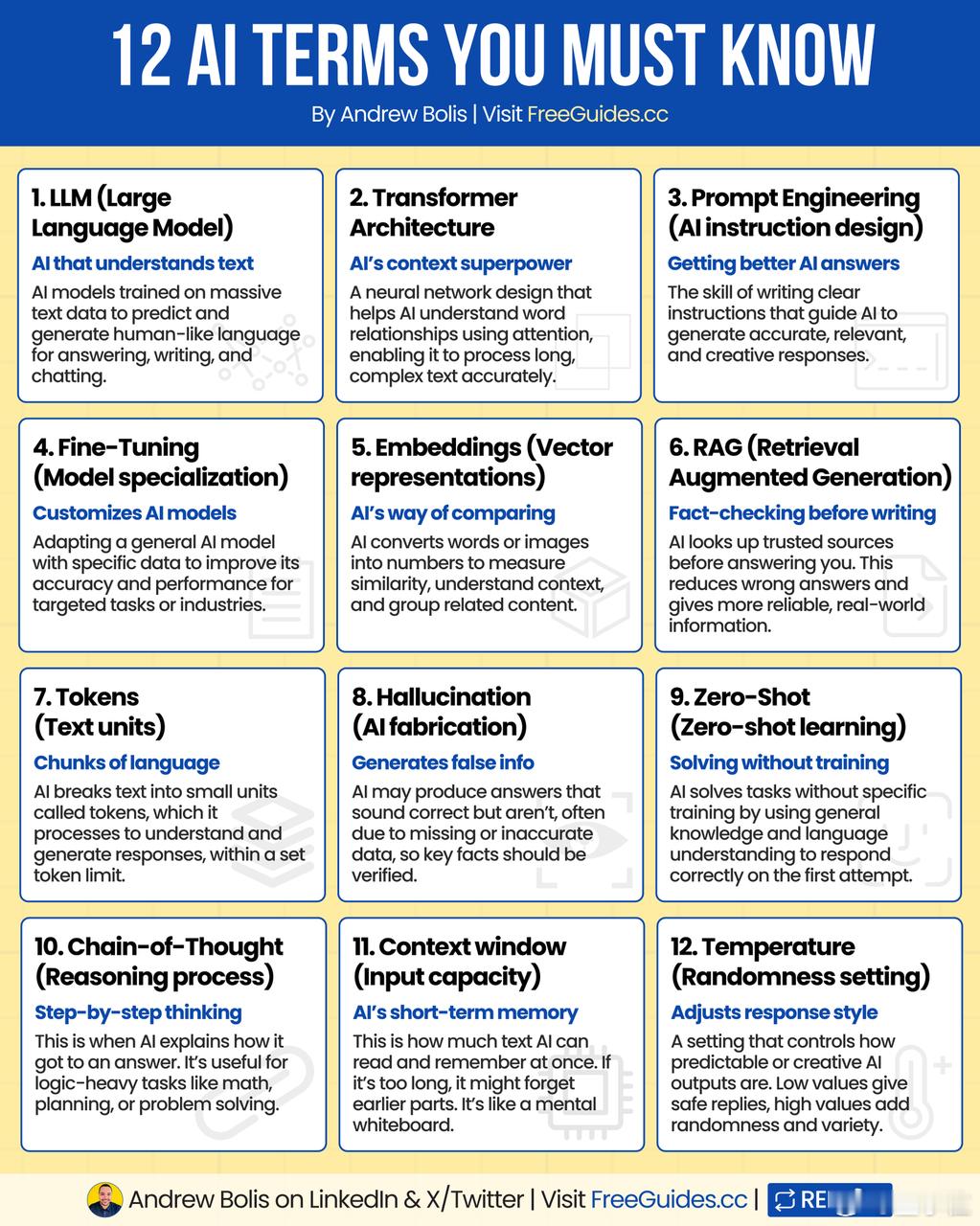

12个AI核心概念必知AI核心术语

你必须知道的12个AI核心术语。(作者:Andrew Bolis)

掌握这12个术语,就掌握了AI的核心概念。

1️⃣ LLM(大型语言模型 / Large Language Model):能“理解语言”的AI

这类模型通过海量文本数据训练而成,具备生成语言的能力,能进行对话、写作、总结、翻译等任务,表现出接近人类的语言理解与表达能力。

2️⃣ Transformer架构(Transformer Architecture):AI理解上下文的基础结构

这是一种神经网络架构,依赖“注意力机制(Attention)”来捕捉词与词之间的关系,特别擅长处理长文本,是现代语言模型如GPT的核心结构。

3️⃣ 提示工程(Prompt Engineering):写出让AI更聪明的指令

通过设计精确、清晰、有上下文的提示语(prompt),用户可以引导AI生成更相关、更准确、更有创意的内容,是使用AI的关键技巧。

4️⃣ 微调(Fine-Tuning):让AI专注某一特定领域

在基础模型训练完成后,再用某个特定领域的数据对其进一步训练,从而提升它在该领域的专业表现,例如医疗、法律、教育等行业。

5️⃣ 向量嵌入(Embeddings / Vector Representations):AI如何“理解”和比较文本

AI将文本转化为数字向量,用于判断语义相似度、分类内容、推荐信息,是搜索、问答系统、内容聚类等功能的核心技术。

6️⃣ 检索增强生成(RAG / Retrieval-Augmented Generation):让AI先查资料再作答

结合生成式AI和检索系统,AI在回答前会先从外部知识库检索相关信息,增强准确性、减少错误、提升答案的权威性与可信度。

7️⃣ Token(文本单位):AI处理语言的基本颗粒

AI处理语言时会将文本切分为最小单位——token,一个单词可能包含一个或多个token。模型的处理能力和响应速度与token数量密切相关。

8️⃣ 幻觉(Hallucination):AI“编造事实”的现象

AI可能会生成看似合理但实际错误的信息,通常源于训练数据缺失、上下文误解或模型过度泛化,因此使用AI生成内容时需特别注意核实关键事实。

9️⃣ 零样本学习(Zero-Shot Learning):AI在没学过的情况下也能答题

即便AI未针对某项任务进行专门训练,也可以凭借已有的知识和语言理解能力,对全新问题作出较为合理的回答。

🔟 思维链(Chain-of-Thought):AI进行推理时的“逐步思考”

指AI在回答过程中,逐步拆解问题并展示中间推理步骤,常用于解数学题、复杂决策或需要逻辑分析的问题,有助于提升回答的透明度与准确性。

11️ 上下文窗口(Context Window):AI的“短期记忆容量”

表示模型一次能处理的文本范围。超过这个范围,AI可能“遗忘”前面的内容,影响回答连贯性,类似白板被写满后必须擦掉旧内容才能写新内容。

12️ 温度(Temperature):控制AI回答的“随机程度”

这是一个生成参数,决定输出的创造性和多样性。温度低时回答更确定、保守;温度高时更有创意、但也可能不够准确。

这些概念涵盖了当前AI模型从结构、训练到生成与推理的关键机制:

结构层面:LLM、Transformer、Embedding

训练层面:Fine-Tuning、RAG、Zero-Shot

生成层面:Prompt、Temperature、Hallucination

推理层面:Chain-of-Thought、Context Window、Tokens

它们是理解和高效使用AI工具的“入门钥匙”。熟悉它们,你将能更有信心地驾驭AI,推动创作、工作和思维的边界。

![ai使用小技巧[吃瓜]](http://image.uczzd.cn/11026722510770026327.jpg?id=0)