为什么要本地部署DeepSeek

为什么要本地部署DeepSeek本地部署大模型(如LLM、多模态模型等)逐渐成为企业或机构的重要选择,主要原因包括以下几个核心优势:

1. 数据隐私与安全敏感数据保护:金融、医疗、法律等行业的数据涉及用户隐私或商业机密,本地部署确保数据全程留在内部服务器,避免上传到第三方云端服务的泄露风险。合规要求:GDPR、HIPAA等法规严格限制数据传输,本地化部署可直接满足数据主权和跨境合规要求(如中国《数据安全法》)。2. 降低网络依赖与延迟离线可用性:在无网络环境(如实验室、军事场景)或网络不稳定地区,本地部署保障服务持续运行。实时性需求:本地推理(如工业质检、实时翻译)可避免云服务的网络延迟,提升响应速度。3. 模型与业务深度定制领域适配:通过微调(Fine-tuning)注入行业知识(如医疗术语、法律条款),提升专业场景准确率。功能扩展:结合内部系统(如ERP、数据库)开发私有功能(如内部知识库问答),避免云服务的通用性限制。持续迭代:可根据业务反馈实时调整模型参数,优化输出质量。4. 长期成本可控高频调用节省成本:对于每日大量调用场景(如客服机器人),本地部署的边际成本低于按次付费的云API。硬件复用:已有GPU服务器集群可复用算力,降低重复投资。5. 技术自主权规避供应商锁定:避免依赖特定云服务商(如OpenAI、Azure)的API政策变动或涨价风险。自主优化:可针对硬件(如国产芯片)进行模型压缩、量化等优化,提升推理效率。6. 特殊场景需求保密性开发:研发保密项目时,本地部署防止代码或数据通过云端泄露。极端稳定性要求:关键系统(如电力调度、自动驾驶)需完全掌控模型行为,排除外部服务故障风险。权衡:本地部署的挑战硬件成本高:需投资GPU服务器(如NVIDIA A100集群)和运维团队。技术门槛:需具备模型部署、分布式训练、优化等工程能力。更新滞后:需自行跟踪模型迭代(如Llama 3→Llama 4),云服务则自动升级。典型适用场景企业级应用:银行风控模型、医院病历分析、制造业质检系统。政府与科研:涉密数据分析、本土语言大模型研发(如藏语、维吾尔语)。边缘计算:嵌入智能设备(如机器人、车载系统)实现端侧AI。总结本地部署大模型的核心价值在于数据可控性和业务适配深度,适合对隐私、实时性、定制化要求高的场景,但需权衡成本与技术投入。随着算力成本下降和开源生态成熟(如Llama、ChatGLM),本地化部署正成为企业AI战略的重要选项。

DeepSeek部署方法硬件要求:

DeepSeek部署方法硬件要求:1000元以上的电脑一台。

系统要求:macOS, Linux, and Windows任意系统,本文以windows系统为例。

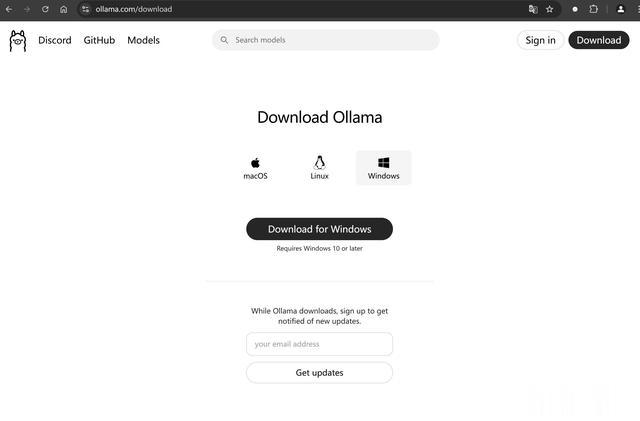

安装ollama软件

下载地址:

https://ollama.com/download

安装ollama软件

安装成功后,电脑任务栏右下角显示ollama图标:

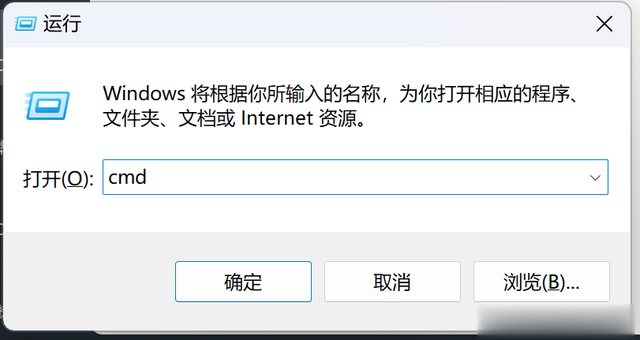

快捷键:窗口键+R

调出运行界面

输入“cmd”后,点击确定,调出命令行窗口。

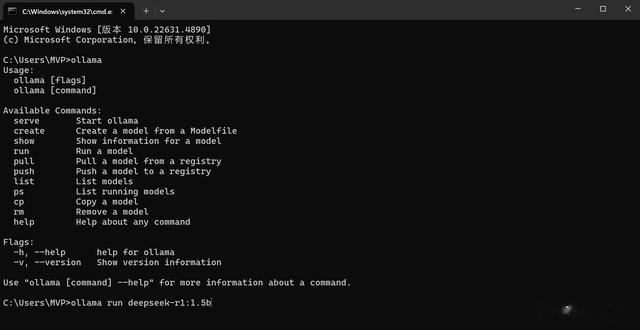

命令行输入“ollama”后,回车。显示如上图,则表示ollama安装成功了。

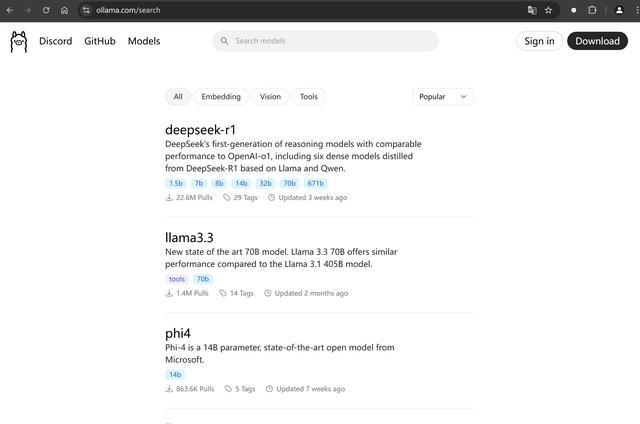

通过ollama下载并部署DeepSeek打开网址:https://ollama.com/search

找到第一行的“deepseek-r1”,点击后跳转到页面:

选择一个模型,配置低就选参数少的,建议先下载1.5b的。

复制命令

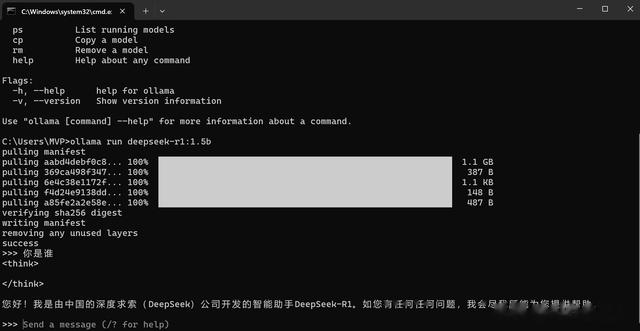

ollama run deepseek-r1:1.5b

ollama run deepseek-r1:1.5b粘贴到命令行窗口中:

开始下载deepseek-r1:1.5b模型:

等待下载完成,下载后显示如下界面:

随便输入一个问题,测试是否能够正常回答,以及回答速度:

如果生成如上回答,则安装成功了。

安装Page AssistPage Assist是Chrome浏览器扩展

扩展链接:https://chromewebstore.google.com/detail/page-assist-%E6%9C%AC%E5%9C%B0-ai-%E6%A8%A1%E5%9E%8B%E7%9A%84-web/jfgfiigpkhlkbnfnbobbkinehhfdhndo?hl=zh-CN&utm_source=ext_sidebar

添加成功后,浏览器扩展现实如下扩展图标,点击后打开如下窗口:

点击如下所示的模型下拉列表,选择刚刚下载的模型deepseek-r1:1.5b。

在下方的输入框中,输入任意问题,如:“你是谁”

如果一切正常,则显示如下:

恭喜你,本地部署deepseek成功了。

收藏、点赞、关注,私信”AI资料“,免费领取AI资料。