你有没有想过,当你接到一个视频电话,看到对方熟悉的脸,听到熟悉的声音,但其实屏幕那头根本不是真人?

这不是科幻片,而是正在全国各地上演的真实”AI换脸诈骗“案件。

甚至一位企业老板,在10分钟内就被骗430万!

而这还仅仅是冰山一角...

惊人的AI诈骗数据

惊人的AI诈骗数据近年来,AI诈骗案件呈爆发式增长。

据相关数据统计,全国范围内AI诈骗案件数量逐年攀升,涉案金额也屡创新高。

同时,从年龄段来看,老年人和青少年是主要受害群体。

老年人因对新技术了解有限,容易被诈骗分子的花言巧语迷惑;

青少年则由于社会经验不足,在网络社交中容易泄露个人信息,从而陷入诈骗陷阱。

在网络社交、购物、娱乐等日常场景中,民众不经意间就可能将个人信息暴露在网络上。

比如,随意填写来路不明的问卷,在注册一些不明网站时毫无保留地提交个人资料,这些行为都如同在自家门口埋下了“定时炸弹”。

诈骗分子通过各种手段收集这些零散的个人信息,再利用AI技术进行分析整合,精准定位目标人群,实施诈骗。

个人信息的大量泄露,无疑为AI诈骗提供了肥沃的“土壤”,大大提高了民众受骗的概率。

AI换脸诈骗

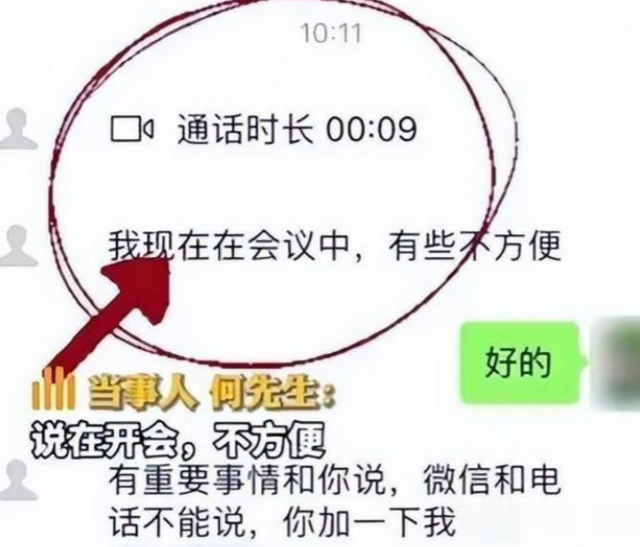

AI换脸诈骗2023年4月,福建的郭先生遭遇了一场精心策划的AI换脸诈骗。

郭先生作为一家科技公司的法人,自认为对AI技术颇为熟悉,却还是未能逃过诈骗团伙的黑手。

他突然接到“朋友”打来的视频电话,视频中“朋友”的面容和声音与真朋友毫无二致。

“朋友”焦急地表示自己在外地与其他公司竞标,资金短缺,急需郭先生帮忙转账。

郭先生在看到熟悉的面容和听到熟悉的声音后,放松了警惕,先后两次向“朋友”指定的账户转账,短短十分钟内,430万元就这样被诈骗分子轻松卷走。

同年7月,广东一位老人也遭遇了类似的AI换脸诈骗。

诈骗分子利用AI技术将自己的脸换成老人儿子的模样,通过视频通话向老人哭诉自己在外地弄丢了银行卡和手机,急需用钱。

老人看到视频中“儿子”的模样,心疼不已,赶忙去银行汇款。

幸运的是,银行经理察觉到异样,及时报警,才避免了老人的财产损失。

AI换脸技术主要基于深度学习算法。

诈骗分子首先会通过网络爬虫等手段,收集目标人物在社交媒体、网络论坛等平台上的照片、视频素材。

接着,利用专业的AI换脸软件,将收集到的素材输入其中,软件通过识别目标人物的面部特征点,如眼睛、鼻子、嘴巴的位置和形状等,再与诈骗分子自己的面部特征进行匹配和替换。

经过一系列复杂的计算和处理,生成逼真的换脸视频。

在实施诈骗时,他们会选择合适的时机,如编造紧急事件,利用受害者的紧张情绪,让其无暇仔细辨别视频的真伪,从而达到诈骗的目的。

由于当前AI换脸技术的逼真度极高,仅通过视频通话,普通人很难直观地辨别出对方是否使用了AI换脸技术,这也使得此类诈骗手段极具迷惑性。

AI语音诈骗

AI语音诈骗2024年3月,湖北孝感的张婆婆接到一个陌生电话,电话那头传来“孙子”焦急的声音。

“孙子”称自己与朋友玩耍时发生争执,不小心摔坏了朋友新买的手机,朋友要求赔偿两万元,否则就报警。

张婆婆听到“孙子”带着哭腔的声音,心急如焚,根本来不及思考,就按照对方的要求准备筹钱。

随后,一名自称是“孙子朋友”的黑衣男子出现,张婆婆在未核实身份的情况下,就将两万元现金交给了他。

直到晚上孙子回家,张婆婆才发现自己被骗。

AI语音克隆技术的实现,主要依靠对目标人物少量语音样本的分析和建模。

诈骗分子通过拨打骚扰电话、在网络音频平台收集等方式,获取目标人物的语音片段。

然后,利用语音合成软件,对这些语音样本进行深度学习,提取目标人物的语音特征,如音色、语调、语速等。

通过对这些特征的模仿和组合,生成与目标人物相似的语音。

在实施诈骗时,他们会结合亲情、友情等情感因素,编造紧急事件,如孩子受伤、朋友急需资金周转等,利用受害者在紧急情况下的慌乱心理,进行情感操控,诱导受害者转账汇款。

对于老年人等对声音辨识度较低、容易受情感影响的人群来说,这种诈骗手段极具杀伤力。

AI情感诈骗

AI情感诈骗2024年8月,上海闵行的刘先生在短视频平台上结识了一位“焦女士”。

两人相谈甚欢,很快便发展成了恋人关系。

此后,“焦女士”经常向刘先生分享自己创业的经历,并以资金不足为由,向刘先生借款。

刘先生在与“焦女士”的频繁交流中,逐渐放下了防备,多次向其转账。

然而,刘先生始终未曾见过“焦女士”本人。

直到后来,他察觉事情不对劲,选择报警。

警方侦查后发现,这个所谓的“焦女士”根本不存在,是诈骗团伙利用AI生成的虚假人物。

他们通过AI技术生成“焦女士”的照片和视频,在社交平台上吸引刘先生等众多男性。

同时,安排专业的聊天业务员,借助AI生成的话术,与受害者建立情感联系,逐步诱导受害者转账。

在这个过程中,刘先生的心理逐渐从最初的好奇,发展为信任,再到最后的依赖,最终陷入了诈骗团伙精心编织的“甜蜜陷阱”,被骗金额超过20万元。

社交平台在这一过程中也存在一定的隐患。

部分平台对用户信息的审核不够严格,未能有效识别出这些利用AI生成的虚假账号。

同时,在信息传播过程中,对于一些异常的引流信息,缺乏有效的监测和处理机制,使得诈骗分子能够轻易地在平台上进行“钓鱼”,寻找目标受害者。

AI诈骗的社会危害

AI诈骗的社会危害AI诈骗给受害者带来的直接影响就是财产损失。

许多受害者辛苦积攒多年的积蓄,可能在一瞬间就被诈骗分子席卷一空。

除了经济上的重创,受害者还承受着巨大的心理压力。

他们往往陷入自责、焦虑、抑郁等负面情绪中无法自拔,对自己的判断力产生严重怀疑。

这种心理创伤可能会持续很长时间,影响受害者的日常生活和心理健康,甚至导致一些人出现精神问题。

一些受害者因为无法承受巨额债务,生活陷入困境,家庭关系也因此变得紧张,原本幸福美满的家庭可能因此支离破碎。

对于企业而言,AI诈骗的危害同样巨大。

一旦企业遭遇AI诈骗,如商业机密被泄露、资金被骗取,首先面临的就是严重的经济损失。

这可能导致企业资金链断裂,影响企业的正常生产经营,甚至面临破产倒闭的风险。

企业的商业信誉也会受到极大的损害。

一旦诈骗事件曝光,客户对企业的信任度会急剧下降,合作伙伴可能会选择终止合作,这对企业的未来发展将产生长期的负面影响。

企业为了应对AI诈骗,需要投入大量的人力、物力和财力,用于加强网络安全防护、培训员工防范意识等,这无疑增加了企业的运营成本,进一步削弱了企业的竞争力。

AI诈骗的频繁发生,对社会信任体系造成了严重的侵蚀。

人们在网络社交、商务往来中,开始对他人的身份和信息产生怀疑,不敢轻易相信陌生人。

这种不信任感逐渐蔓延,导致人与人之间、民众与机构之间的信任度降低,影响了社会的和谐稳定。

AI诈骗还对社会金融秩序造成了干扰。

大量资金被骗取后,可能流入非法渠道,扰乱金融市场的正常运行。

同时,网络安全环境也受到威胁,诈骗分子的猖獗行为使得人们对网络环境的安全性产生担忧,阻碍了互联网行业的健康发展。

这些都对社会的稳定和谐发展构成了潜在威胁。

结语

结语AI诈骗作为一种新型的诈骗手段,以其高隐蔽性、高成功率和巨大的危害性,给个人、企业和社会带来了前所未有的挑战。

其手段层出不穷,从AI换脸、AI语音到AI情感诈骗,每一种都让人防不胜防。

然而,我们不能因此而对AI技术望而却步,更不能任由诈骗分子肆意妄为。

让我们携手共进,向AI诈骗说“不”,守护我们的财产安全和社会稳定。

参考资料