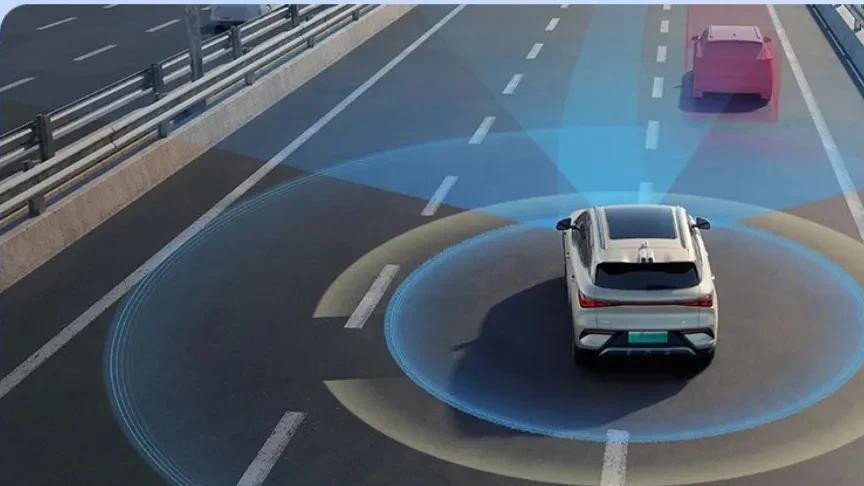

当你在一个晴朗的周六下午,开车带着全家出游,无需操心路况,只需输入目的地,然后放松享受车窗外的美景时,你会不会突然想到一个问题:假如这个自动驾驶的车子遇到了无法避免的事故,车上的你和路上的行人,车子会选择保护谁?

自动驾驶技术为何仍需法律限制?

如今,自动驾驶技术发展迅速,从最初的辅助驾驶到如今的高度复杂的自动驾驶系统,科技进步带来了便利,但也带来了不少问题。

尽管许多车企宣传自家的自动驾驶系统已经非常成熟,比如特斯拉的“完全自动驾驶”功能或是华为ADS 2.0这样的技术,实际上,法律对这类功能依旧有严格的限制。

目前,全球法律普遍将自动驾驶限制在L2级别,这意味车辆虽然有辅助驾驶功能,但驾驶员依然需要随时准备接管车辆。

这一限制是因为自动驾驶技术尽管在不断进步,但在某些情况下仍然不够完美。

即使是最先进的系统,也可能因为各种硬件和软件的原因发生意外。

而这一点正是2018年的Uber事故所揭示的。

2018年Uber事故揭示的问题2018年3月18日,美国亚利桑那州的一条马路上,发生了一起令人震惊的车祸。

一辆Uber的自动驾驶测试车撞上了一位推着自行车过马路的行人伊莱恩·赫茨伯格,导致她当场死亡。

在事故发生时,车内的安全员正低头看手机,而车辆的自动驾驶系统在事发前6秒便已检测到行人,但因为算法将她误认为“塑料袋”而未作出紧急反应。

这个事故告诉我们,即使是配备了多重传感器——如激光雷达、视频摄像头等的自动驾驶车辆,也可能因为数据误差、硬件故障或者算法缺陷,而未能避免致命的车祸。

对于大多数人来说,接受“人犯错”是有心理准备的,但当自动驾驶的车辆被认为能够比人类驾驶更安全的时候,却仍然出现错误,公众就会对这种技术感到不安。

算法选择中的多维度伦理难题事发现场,自动驾驶汽车究竟该如何做出抉择?

如果它必须在两难之间做出选择,一边是车内的乘客,一边是外部行人,它会偏向哪一方?

让我们进一步探讨一下。

算法选择实际上是一个复杂的多维度问题。

首先是空间维度:如果道路上突然出现一群违规穿越马路的人,汽车的选择是撞向这群人,还是偏向撞上斑马线上遵守交通规则的1名儿童?

再比如时间维度:是否要通过牺牲当前一个行人的性命,来避免接下来可能的连环追尾事故,进而造成更多人的受伤或死亡?

德国伦理委员会曾提出过18条自动驾驶的伦理准则,其中一条是“禁止基于年龄、性别等特征进行差异化保护”。

但测试显示,78%的受访者表示应优先保护儿童。

这一结果非常现实:谁也不愿意买一辆可能会在紧急状况下“牺牲”自己的汽车。

这也使得奔驰宣布其L3级自动驾驶系统优先保护车内乘客后,引起了不小的争议。

寻找自动驾驶伦理困境的解决之道面对自动驾驶技术所带来的伦理困境,我们需要从技术、法律和伦理三个方面共同探讨解决之道。

关于技术层面,提升自动驾驶系统的安全性能是无可争议的首要任务。

但现实是,再先进的技术也不可能完全避免事故发生。

就像目前的一些高科技传感器能有效地检测到障碍物,但如果算法设计不周或数据培训不充分,仍有可能出错。

因此,技术的提升必须与对系统的全方位、严格的测试同步进行。

在法律层面,德国推出的《自动驾驶法》是一个有趣的尝试。

他们创立了一个“动态责任矩阵”,在系统发生故障时,由制造商承担大部分责任(70%),人为干预不当,用户承担一定责任(25%),而非人力可控的情况则由政府基金赔偿(5%)。

这个模式正在欧盟立法委员会讨论,值得全球借鉴。

此外,达成区域性伦理共识也是一个重要的课题。

麻省理工学院的道德机器实验收集了全球众多参与者的伦理选择,结果显示不同地区对伦理决策有不同偏好:东方国家更倾向保护多数人,而西方国家则更重视规则的优先性。

这提示我们,自动驾驶的伦理准则既需要全球通用的底线,也必须尊重地区性的差异。

尽管自动驾驶技术的不断提升让我们感到激动,但不得不承认,它的伦理问题不像代码那么简单。

从技术到法律再到伦理,我们需要全方位、多元化的努力来共同解决。

在未来,当你享受自动驾驶汽车带来的便捷时,请记住,技术进步并不是万能的。

我们仍需不断反思和改进,寻找各方利益的平衡点。

最终,自动驾驶的安全并不仅依赖于“聪明的算法”,更需要我们每一个人对于科技、人性和道德的深刻理解和尊重。

只有这样,自动驾驶汽车才能真正走进我们的生活,并成为我们道路上的守护者。