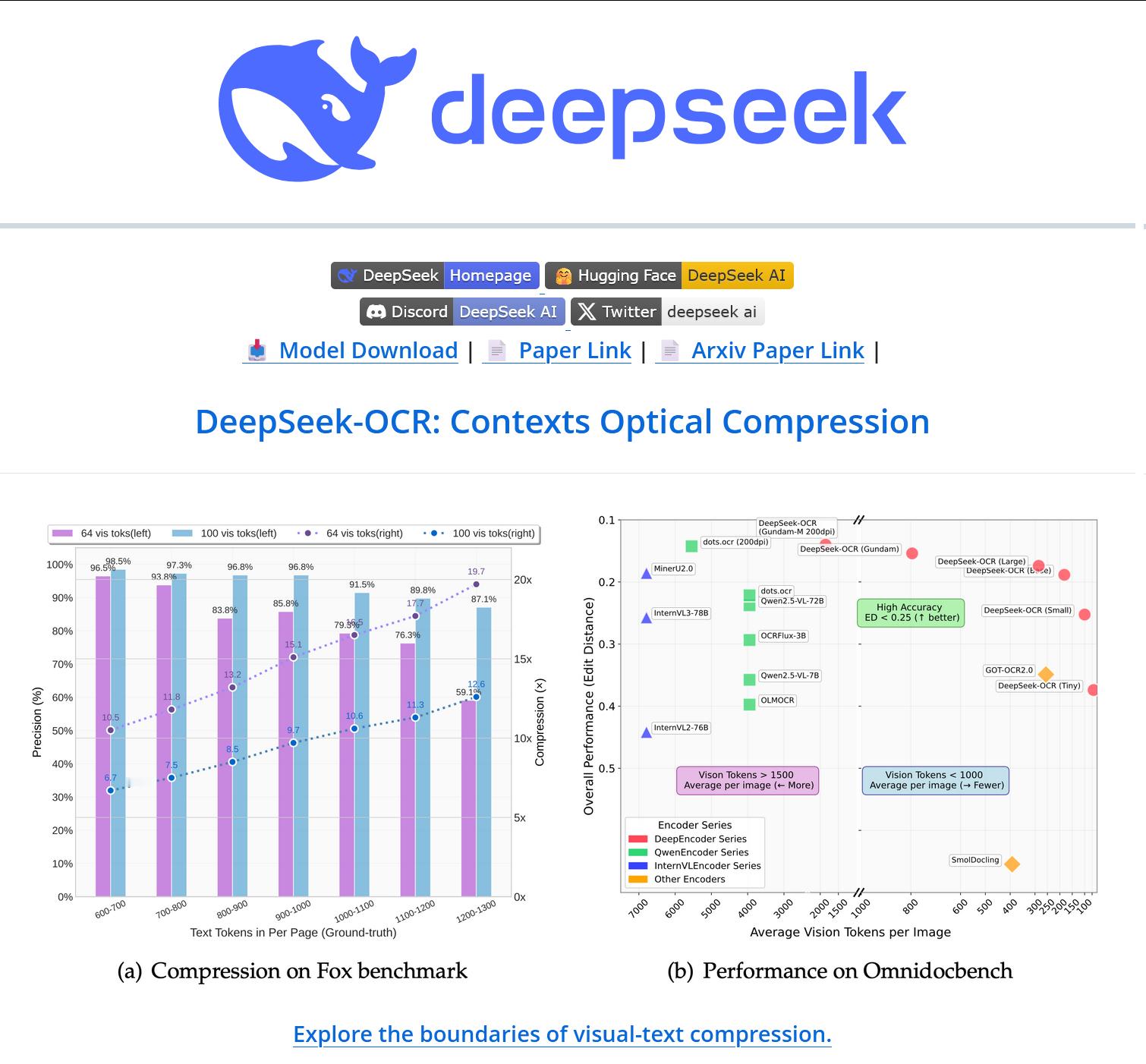

【Deepseek新模型将文档转为图像:“视觉文本压缩”最多可减少 20 倍】

(汤姆硬件)据《南华早报》报道,深寻人工智能 (Deepseek AI)的中国开发者发布了一个新模型,该模型利用其多模态功能,通过先将复杂文档和大段文本转换为图像,从而提高处理效率。视觉编码器能够获取大量文本并将其转换为图像,之后访问时,所需的标记数量将减少 7 到 20 倍,同时保持了令人印象深刻的准确度。

DeepSeek 是中国自主研发的人工智能,它在 2025 年初震惊了世界。它展现出与 OpenAI 的 ChatGPT 或谷歌的 Gemini 类似的能力,但开发所需的资金和数据却少得多。自那以后,开发者们一直致力于提高人工智能的效率,最新版本的 DeepSeek-OCR(光学字符识别)能够对大量文本数据进行令人印象深刻的理解,而无需通常的令牌开销。

开发人员表示:“通过 DeepSeek-OCR,我们证明了视觉文本压缩可以在不同的历史背景阶段实现显著的标记减少(7 到 20 倍),为处理长上下文计算提供了一个有希望的方向。”

新模型由两个组件组成:DeepEncoder 和充当解码器的 DeepSeek3B-MoE-A570M。编码器可以接收大量文本数据并将其转换为高分辨率图像,而解码器则尤其擅长获取这些高分辨率图像并理解其中的文本上下文,而且所需的标记比直接将文本输入 AI 系统要少。它通过将每个任务分解为独立的子网络来实现这一点,并使用特定的 AI 代理专家来针对每个数据子集进行处理。

该技术在处理表格数据、图表及其他信息可视化形式方面表现尤为出色。开发者指出,这在金融、科学或医学领域可能具有特别重要的应用价值。

在基准测试中,开发者宣称当减少的字符数量低于10倍时,DeepSeek-OCR仍能保持97%的信息解码准确率。若压缩率提升至20倍,准确率将降至60%。虽然这种效果不尽如人意,表明该技术存在收益递减现象,但即使仅采用1-2倍压缩率就能实现近100%的准确率,仍能显著降低运行众多最新AI模型的成本。

该技术还被宣传为开发未来模型训练数据的途径,但即便仅引入几个百分点的偏差,在该阶段引入错误似乎仍是个糟糕的主意。

若您想亲自尝试该模型,可通过在线开发平台Hugging Face和GitHub获取。